ChatGPTでデータ分析 #6 クラスタ分析

1.キャラクター

彼は、異なるデータポイントを結びつけ、類似性に基づいてクラスタを形成することに情熱を持っています。

また、好奇心旺盛で冒険的な性格を持ち、データの中に潜む未知のグループを発見することに喜びを感じます。

2.どんな時に活躍する

クラスター分析は、データ内の類似性やパターンを探索的に分析するために使用される統計手法です。

クラスター分析は、データを探索的に分析し、隠れたパターンや構造を発見するために広く使用されています。

ただし、クラスタリングの結果は、選択した距離尺度やクラスタリングアルゴリズムに大きく依存するため、解釈には注意が必要です。

3.データ概要

データは、ある商品の購入者(id)ごとの年齢(age)、収入(income)、購入頻度(purchase_frequency)を示しています。年齢、収入、購入頻度から購入者を分類、つまり似た者同士でグループ化します。

分類ができれば、年齢、収入、購入頻度で次の打つ手の仮説が立てられますね。

4.分析

以下、ChatGPTとの対話による分析実行ですが、

You:私のプロンプトコメントです。

He:ChatGPTのコメントを元に要約記述したものですので、是非ご自分で確かめてください。

< >:補足として追加記載したコメントです。

You

market_segmentation_sample.csv添付

あなたは統計学、機械学習およびデータ分析のスペシャリストです。添付されたデータは、ある商品の購入者(id)ごとの年齢(age)、収入(income)、購入頻度(purchase_frequency)を示しています。年齢(age)、収入(income)、購入頻度(purchase_frequency)を変数として購入者をクラスタ分析で分類したいと考えています。手順を示したうえで、分類をお願いします

He

クラスタ分析を行う手順は以下の通りです。

1.データの準備:

データを読み込みます。

必要に応じてデータの前処理を行います。

欠損値の処理、変数の正規化など

2.最適なクラスタ数の決定:

エルボー法やシルエット分析などの方法を用いて、最適なクラスタ数を決定します。

3.クラスタリング:

K-meansや階層的クラスタリングなどのアルゴリズムを用いて、データをクラスタに分割します。

4.結果の解釈:

各クラスタの特徴を分析し、意味のあるセグメントにラベルを付けます。

それでは、Pythonを使用してクラスタ分析を行ってみましょう。まず、データを読み込んで前処理を行います。

データが正常に読み込んで、標準化しました。

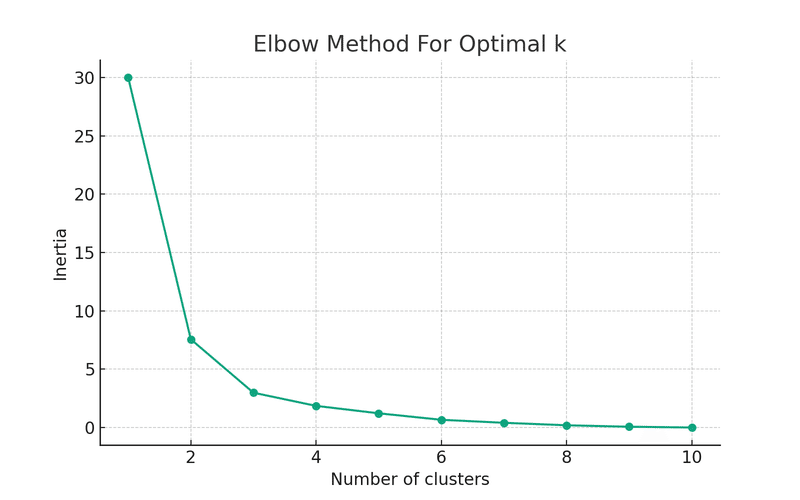

次に、エルボー法を用いて最適なクラスタ数を決定します。

エルボープロットから、クラスタ数が3か4のところで曲線の勾配が緩やかになっていることがわかります。

ここでは、クラスタ数を3としてクラスタリングを行います。

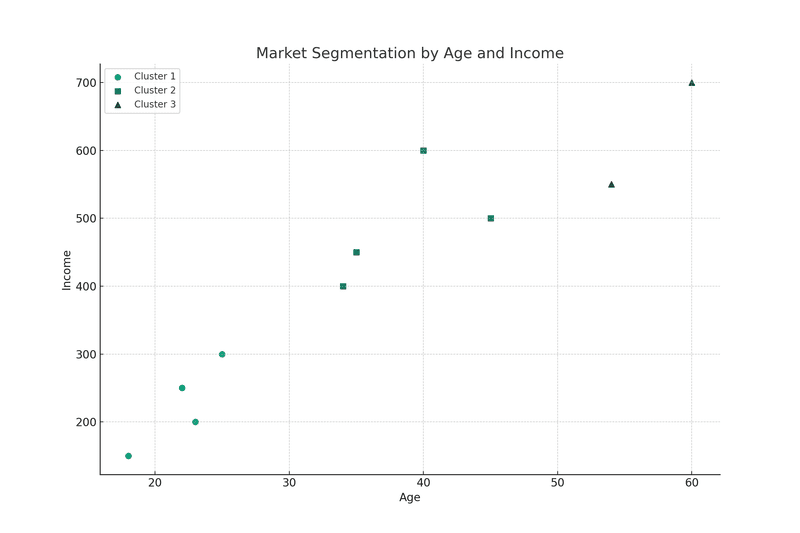

結果を見ると、購入者は3つのクラスタに分類されています。

年齢と収入の関係を可視化したグラフでは、各クラスタが明確に区分されていることがわかります。

この結果をもとに、各クラスタの特徴を分析し、マーケティング戦略などに活用することができます。

例えば、若年層で収入が低いクラスタには割引キャンペーンを、収入が高いクラスタにはプレミアム商品のプロモーションを行うなどの戦略が考えられます。

You

購入頻度との関連がわからないのですがいかがでしょうか。

<前述では、年齢と収入の関係しか分析されてませんでしたので、改めて聞いてます。>

He

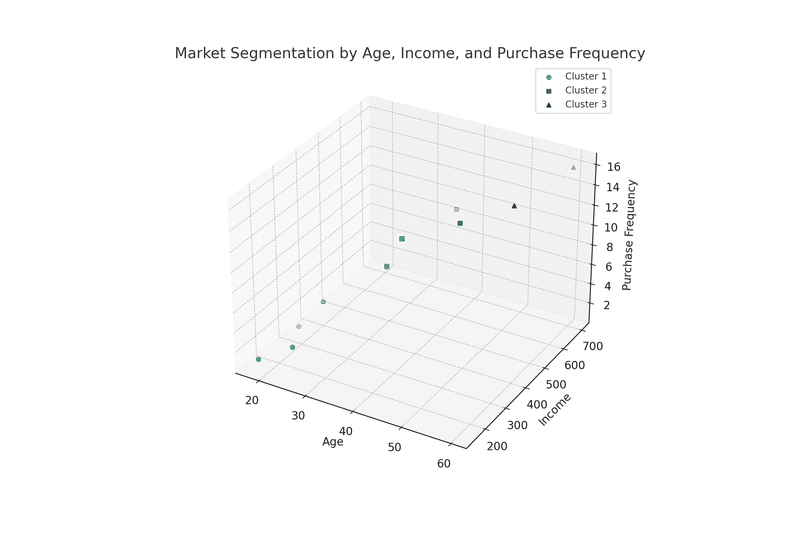

購入頻度との関連を調べるために、3次元の散布図を作成して、年齢、収入、そして購入頻度の3つの変数を同時に可視化してみましょう。

3次元の散布図を作成しました。

このグラフでは、年齢、収入、購入頻度の3つの変数を同時に可視化しています。

クラスタごとに異なるマーカーを使用しているため、各クラスタの特徴がより明確に理解できます。この分析から、購入頻度もクラスタリングに影響を与えていることがわかります。

You

エルボープロットから、曲線の勾配が緩やかになっているところでクラスタ数が決められるのはなぜでしょうか。

He

エルボープロットでは、クラスタ数(k)に対してクラスタ内誤差平方和(InertiaまたはSSE:Sum of Squared Errors)をプロットします。

クラスタ内誤差平方和は、クラスタ内の各点とそのクラスタの中心との距離の二乗和で、クラスタリングの品質を示す指標の一つです。

クラスタ数が増えるほど、クラスタ内誤差平方和は減少しますが、ある点から減少率が急激に小さくなります。

この「肘」のように見える点がエルボーポイントと呼ばれ、この点を最適なクラスタ数とするのがエルボー法です。

このポイントよりもクラスタ数を増やしても、クラスタ内誤差平方和の減少が小さくなり、クラスタリングの改善が限定的になるため、効率的なクラスタ数と考えられます。

つまり、クラスタ数を増やしても得られる情報の増加が少なくなるため、このポイントを選ぶことが一般的です。

You

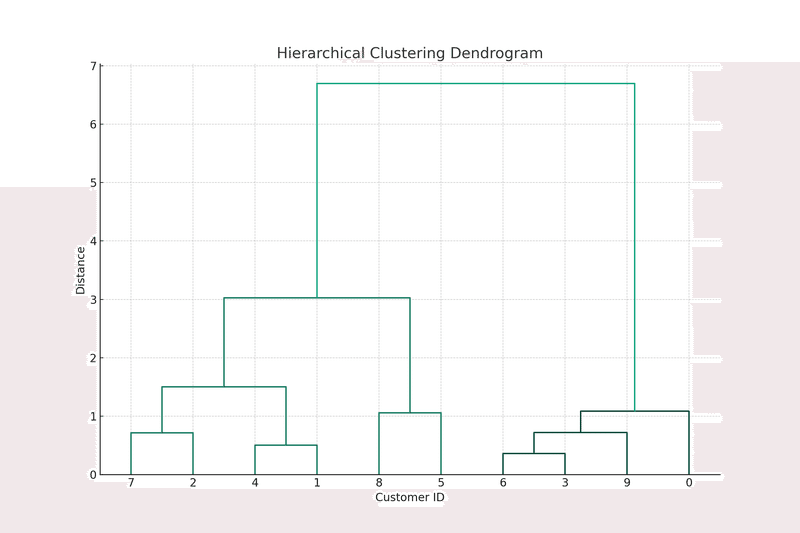

なるほど、ありがとう。今回の結果のクラスタリングを樹形図で描けますか。

He

はい、クラスタリングの結果を樹形図(デンドログラム)で描くことができます。

ただし、樹形図は通常、階層的クラスタリングの結果を可視化するために使用されます。

今回はK-meansクラスタリングを使用しましたが、階層的クラスタリングを使用して同様のクラスタ数でクラスタリングを行い、その結果を樹形図で描いてみましょう。

樹形図(デンドログラム)を作成しました。

このグラフは、階層的クラスタリングの結果を示しており、横軸は個々のデータポイントを表し、縦軸はクラスタ間の距離を示しています。

クラスタが結合される点での縦線の高さが、そのクラスタ間の距離を表しています。この樹形図を用いて、異なるクラスタ数での分割の様子を観察することができます。

5.注意点

You

ありがとう。では、クラスタ分析するときの注意点を教えてください。

He

クラスタ分析を行う際に注意すべき点はいくつかあります。

1.データの前処理:

欠損値の処理や外れ値の除去、変数の標準化など、適切なデータの前処理を行うことが重要です。

異なるスケールの変数を含む場合、標準化や正規化を行うことで、すべての変数が同等に扱われるようにします。

2.クラスタ数の選択:

エルボー法やシルエット分析などを使用して最適なクラスタ数を決定しますが、これらの方法が常に明確な答えを提供するわけではありません。場合によっては、ドメインの知識やビジネス上の要件を考慮してクラスタ数を選択する必要があります。

3.クラスタリングアルゴリズムの選択:

使用するアルゴリズム(K-means、階層的クラスタリング、DBSCANなど)は、データの特性や目的に応じて選択する必要があります。

例えば、K-meansは球形のクラスタを仮定していますが、DBSCANは任意の形状のクラスタを検出できます。

4.結果の解釈と評価:

クラスタリングの結果を解釈し、それが実際のビジネスや研究の問題にどのように適用できるかを検討することが重要です。

クラスタの特徴を分析し、それぞれに意味のあるラベルを付けることで、結果の理解が深まります。

5.検証:

クラスタリングの結果はしばしば主観的であるため、異なるアルゴリズムやパラメータで実験を繰り返し、結果の一貫性を確認することが重要です。

必要に応じて、外部の基準やドメインの専門家の意見を参考にして結果を検証します。

これらの注意点を考慮することで、より信頼性の高いクラスタ分析の結果を得ることができます。

6.参考文献

(1)統計学が最強の学問である[実践編]

(西内啓著、ダイヤモンド社)

おすすめ!

(2)Pythonで儲かるAIをつくる

(赤石雅典著、日経bp)

機械学習の開発手順から解説してくれてます。

(3)本当に使えるようになる多変量解析超入門

(加藤剛著、技術評論社)

おすすめ!

(4)マンガでわかる機械学習

(荒木雅弘著、オーム社)

マンガと侮るなかれ!ちゃんと数学的な背景も解説してくれてます。

(5)ビジネスに活かすデータマイニング

(尾崎隆著、技術評論社)

(6)らくらく図解アンケート分析教室

(菅民郎著、オーム社)

この記事が気に入ったらサポートをしてみませんか?