『分析モデル』本サポートページ

この記事は、以下の本『分析モデル入門』のサポートページです。

参考文献、更に勉強したい人のための文献と、誤植修正を提示します。

第1-3章 回帰分析 & ロジスティック回帰分析

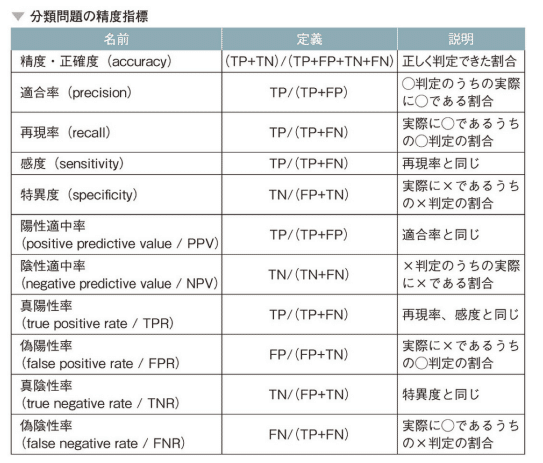

この章では、回帰分析、ロジスティック回帰分析を扱っています。

他、精度指標や、解釈についても話しています。

特に、この部分は、国宝級の資料じゃないかと思います(笑)

以下に、参考文献を挙げます。

まずは統計学入門。東大の統計学の教科書です。硬い書き口ですが、しっかりと基礎が書かれています。数式は多めなので、苦手な人は苦労するかも。

安心と信頼の統計ライブラリーシリーズの回帰分析。高いけど、めちゃ分厚くて、回帰分析マスターになるには持ってこい!(ただ、ちょっと、詳しすぎるので、オタク向きかも)

安心と信頼の統計ライブラリーシリーズの、ロジスティック回帰分析版。中身のソースコードは古くて使い難いですが、大量の事例とともに、ロジスティック回帰分析の使い方や魂がわかる一冊。

この本は本当におすすめ。回帰分析一つで、かなり深い分析が実行できます。計量経済学の分野では、モデルを凝りすぎると、分析者のバイアスが強いとみなされる傾向があり、仮説の鋭さと、データの良さから、比較的単純なモデルで分析する文化があります。

回帰分析一つで、非常に鋭い分析をじゃんじゃん出してくれて、本当に面白い一冊。

機械学習大好き系人材には、特に手にとってほしいです。

言わずとしれた PRML です。数式は結構重ためなので、数式得意な人の身におすすめ。やいのやいの言われることが多い本ですが、読める人は絶対読んだほうがいい本だと思います。ベイズ的考え方の基礎がわかりやすい本だと思います。

第4章 Table Data 機械学習

この章では、決定木、Random Forest、勾配ブースティング決定木などの木系のアルゴリズムや、TabNet 等の、Table Data 向けの機械学習技法を紹介しました。

ぶっちゃけ、本を読んで勉強したのではなくて、ネットで調べて学びました。良い本があったら教えて頂きたいです!

いくつか、Web 上の資料のサンプルを紹介するので、知りたい人はそれを読んでみてください。

LGBM 公式ドキュメントです。最後には公式ドキュメントと論文が最強!

論文の pdf → https://proceedings.neurips.cc/paper/2017/file/6449f44a102fde848669bdd9eb6b76fa-Paper.pdf

CatBoost 公式ドキュメントです。最後には公式ドキュメントと論文が最強!

XGBoost 公式ドキュメントです。最後には公式ドキュメントと論文が最強!

TabNet の論文もおいておきます。

リスナーさんから教えていただいた本

以下の2冊を Hiroto T. さんから教えていただきました。なんか良さそう!(^o^)

ありがとうございました!

第5-10章 深層学習 (CV & NLP)

この範囲では、Computer Vision (CV) と Natural Language Processing (NLP) の深層学習モデルを紹介しています。参考文献と言われると、ほぼ、ひたすら原論文ということになると思います。

一応、以下、原論文、私の動画、参考になる本を混ぜて登場させていきます!

深層学習入門

深層学習の入門はこれ!

この本は、基礎から専門的なことがしっかりと書かれていておすすめです。

2の方は、やや専門家向け。学習のテクニックなど、より実践的なことが書いてあります。

最近話題のこの本は、Large Langugage Models 時代の perspective を掴むのにいいかも。Rapid Changing なので、読むなら早めに!

Computer Vision 系の深層学習

私の動画シリーズや、『分析モデル本』最大の元ネタは、この本です!

基本、有名モデルはこの中に書いてあるので、参考文献欲しい人は、これを見てみると良いかも!

畳み込み層の基礎については、この動画が一番わかり易いと思います。

(channel 方向についてあまり語ってないので、そこは以下のより専門的な資料で補ってください。)

最古の CNN である、LeNet の紹介です。(諸説あり)

1990年代に作られた CNN で、今の大 AI 時代の源流の一つです。

pdf は、LeNet5 の原論文です。

VGG もこの書籍や、動画に書いてあります。当時ちょい前は、転移学習といえばこれだったんだけどなぁ。今になってはもはや、歴史の中の技術だと思います。

GoogLeNet の Inception Module や、この跡に続く Xception など、dense 化の技術が一斉を風靡していた時代でした。興味ある人は、ぜひ見てみてください!

書籍では、Xception は紹介していないですが、ここには載せておきます。

真打ち登場!言わずと知れた ResNet です。私の書籍と動画では、論文の主張を尊重して、ResNet の魅力は「恒等写像の学習」にあると紹介しましたが、現代的な視点では、「購買消失・発散の解消」等の、学習ダイナミズムへの影響も大きい様です。

その視点は、先ほども紹介した、こちらに詳しいです → ディープラーニングを支える技術

Natural Language Processing 系深層学習

最初は word2vec! このモデルは、単一のモデルではなく、複数種類のモデルの総称です。これに気づくまでは、あらゆる解説を読んでいても混乱していた、、、。それを意識しながらぜひ、いろんな文献を見てみてください!

RNN については、こちらの動画を参照してください。混乱ポイントについても、それなりに話されています。

次は LSTM です! NLP への利用は減った可能性もありますが、音声などの系列データでは未だに現役で、結構イイイ性能を出してくれますよ!

最新モデルとして、RWKV というのもあります。なんか、RNN で Transformer くらいすごいらしい。私はまだよくわかっていません。とりあえずおいておきます。

Transformer 系

以降、Transformer 系の、動画と論文をおいておきます。基本的には、私は、原論文を読んで勉強しました。わかりやすいと言われる解説は色々ありますが、読んでないのでなんとも言えません、、、。

まずいくつか書籍を紹介し、その後、論文を紹介します。

古くからある、hands on 系の書籍です。これを見れば、使い方がある程度わかるはず! 現代 (2023) の爆発的発展前の書籍なので、いつまで鮮度があるかはわかりませんが、多くの人が読んだ本であるのは間違いないはず!

Transformer! 今の AI の大発展の基礎となったモデルです。以下からどうぞ!

BERT は、今でも、文章を特徴量化したり、単語ベースのタスクに広く利用されています!データサイエンティストはこっちのほうが馴染み深いかな?

GPT は実は、BERT よりちょっと早く出ています。この時代は BERT のほうが全然すごくて、実業界でも注目されていました。(いまや、世間での注目レベルは、GPT が圧勝ですが、、、!)

1-3まとめてどうぞ!

Radford, Alec, et al. "Improving language understanding by generative pre-training." (2018).

GPT シリーズ以外の超重要論文も、2つ紹介しておきます。

まずは T5 (Text-To-Text Transfer Transformer) です。これが、I/O を全部テキストにして、あらゆる問題を一つのモデルで解いてしまおう! という野心的な研究でした。

当時は、全部を LLM でやるより、個別モデル作ったほうがいいに決まっていると思っていましたが、ChatGPT などが出てきて、T5 の世界観が正しかったんだなぁと実感しました。

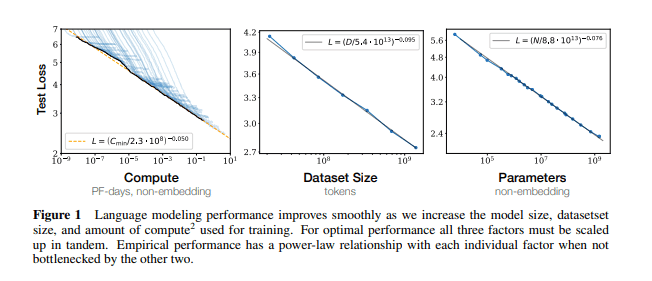

Scaling Law の超重要論文! リソースさえ突っ込めば、冪乗的に精度が良くなるという事実を示した論文。

これを見て、研究者は、興味を失ったりしていて(金さえあれば精度出るので)、私もそういう感想でしたが、

これを見て、ビジネスマンが、すごく興味を持ち始めました(金さえあれば精度出るので)。

で、OpenAI と Microsoft が組んで、生み出されたのが ChatGPT や GPT-4 なのです。

これ、当時、気づけなかったなぁ、、、。

Scaling Law の論文は図がきれいなので、眺めるだけでもおすすめ!

その後の発展として、1つだけ紹介。Data Centric AI の路線の研究です。

Data Centric AI というのは、モデル磨くより、データきれいにしたほうがいいのではないかという考え方です。

で、実際、めちゃデータきれいにして、教科書レベルにしたら、Scaling Law がよりパワフルになったよという研究です。

画像生成系

もはや世界の発展が早すぎて、何を参考文献としたらいいかわかりません、、、。とりあえず、Diffusion Modelsを動かしてみたり、論文を読んでみたりしたらいいと思います。

第11章 統計的言語モデル

before Deep Learning 時代の NLP も紹介しています。

この2冊の内容が11章の内容の軸になっています!

自然言語処理に機械学習を利用する基礎が書かれています。現代的には若干古いと思われますが、基礎をじっくり勉強するにはちょうどよいと思います。

潜在ディリクレ配置 (Latent Dirichlet Allocatoin / LDA) と呼ばれる、ベイズ系の教師なしグルーピングの技術を解説した本です。ベイズのモデルから、その推定法まで書いてあります。推定法は、いつものガチベイズという感じで、結構数式が重ためです。概要を知りたいだけなら私の本でいいかも。数学的背景を知りたければこれ!

第12章 いろんなデータ

グラフ・ネットワーク分析

いろんな本を参考にして、この章を書き上げました!

まずは、非 deep 系をまとめます。

この本は、何と言っても、統計的な手法の解説が最も充実しています!やはり、プロ向け統計は、R関連の書籍がいい場合が多い印象です。

中心性についても、10種類くらいの指標が書いてあった気がします。一番オススメはこれ!

以下の三冊も参考にしましたが、同時に読んだので、どれがどういう本だったか記憶が曖昧、、、。

本が手元にあるときに追記しますが、どれを買ってもおすすめではあります。

Graph Neural Network については、以下のサーベイ論文を参考にしつつ、適宜引用されている論文を見て作りました。当時最良のサーベイ論文の一つで、相当いい感じなので、長らく愛せる論文ではないかと思います。

理論解析にて、Laplacian の固有関数を見ることが Fourier 変換であるという主張をしました。やっぱり、Laplacian の固有関数を見るといえば、Hodge de Rham Kodaira の定理とかいいですよね。ほかにもやっぱり、指数定理とか、最高ですよね。

指数定理の参考文献として、以下の本を挙げておきます。

(冗談です。数学科の学部生や院生が読むような本です。気軽に手を触れると火傷します。)

Fourier 変換といえば、群の Pontrjagin dual も有名ですよね。私もこれ昔勉強して、とても楽しかったです。

(冗談です。数学科の学部生や院生が読むような本です。気軽に手を触れると火傷します。)

地理空間データ分析

SARARモデルなど、本書の地理空間データ分析の主要な内容は、この書籍に頼っています。一番抽象的に書いてあって、数学バックグラウンドの私には一番 happy な本でした!

様々なモデルが網羅的に載っているので、全体像をしっかり知りたい人におすすめ。

ですが、普通にちょろっと地理空間データ分析をやってみたい!という人には重すぎるかも。

次の本は、クリギングや検定等の内容が充実しています。統計ライブラリーは、検定の話が充実していたり、最尤法等の基礎理論からの説明が充実している印象。検定等で実用に使いやすい & 理論もちゃんとしている印象です◎

(いつもの統計ライブラリーくらいの数式があります。基礎しっかり系、だけど、激しすぎないくらいです。)

この本は、計量経済学のために、空間統計をやる本です。軽量経済系にしては、数式ヘビーですが、例として軽量経済の事例が扱われているので、解釈のイメージが湧きやすくてとてもよいです。

最後の本は、定常分布の定義から始まる、超絶数式ヘビー本です。複素とかもじゃんじゃん出てきて、数学者的には happy!だけど、実用という意味ではどこまでありがたいのか未知数、、、。

理論に強くなりたい人におすすめ!

もし、どなたか、サクッと地理空間データ分析ができる本を知っていたら教えていただきたいです。

3次元データの分析

この人に教えてもらいながら書きました。参考文献、、、ならぬ、参考美少女です。

全く関係ないですが、この前後で、色々と3次元データの良い書籍が充実してきました。特にこちらの特集が入門におすすめです。

第13-15章 強化学習

一番難しかった!!!めちゃ勉強しながら書きました。

全体像をつかみやすいのは、今井先生のこのスライドです。何度も読みました(笑)

全体像を簡単につかめる資料はほぼこれしか存在しないのではないかと思います。(あったら教えてください!)

ただ、細部は当然わからないので、これをまず読んでざっくり全体を把握したあと、別の本で細部を埋めるのがいいと思います。

(そして、全体像を見失ったら、何度もこれを見に戻ってくるのです!)

やっぱり、分厚い正当な教科書が一番よい! ということで、これを紹介します。Sutton 先生の強化学習の和訳です。

強化学習の基礎から応用まで、超幅広く、分厚く(物理)書いてある書籍です。学生さんや、ここでプロになろうとしている人は、一度読んでみてはいいのではないでしょうか?

各種アルゴリズムの説明はもちろん、理論的なつながりもあるし、脳神経科学との関連も書かれていて、非常に重厚な1冊です。

英語版で良ければ、pdf が公開されているので、そちらが好きな人はこっちをどうぞ!

青い方の強化学習! こちらは、強化学習の理論がしっかり書いてあります。ベルマン方程式の解の存在性などもしっかり書いてあって、理論家的にはとても happy です。

ただ、今をときめく、深層強化学習についてはほぼ書いてないので、最先端にいきなり行きたい人にはおすすめではありません。

緑の方の強化学習! こっちは、サンプルコードを動かしながら強化学習を学べます。ただ、こちらも、深層強化学習は手薄で、動的計画法等が中心です。

今をときめく深層強化学習をやりたい人向けではないです。

将棋 AI を作れる本です!

dlshogi の山岡さんが書かれた本です。今(2023年)となってはやや古い内容もありますが、深層強化学習でゲーム AI を作りたい人にはおすすめ!

すごい AI を作りたい! という欲望に対応する本はこれです。

こちらの書籍のほうが、より発展形で、より強い将棋 AI を作れます。一冊目として上をやって、次に下をやってみると、幅広に理解できると思います。

ですが、将棋 AI の世界も日進月歩で、これを読んでも最先端には至りません。最新の発展を自らキャッチアップして、ついていく必要があると思います!がんばれ!

最後に! 強化学習の動画シリーズを、満を持して始めました!

ほんのときより、より、強化学習に向き合い、内容をかなりバージョンアップして作る予定です!見てね!

(やっぱり、網羅性は本、解説のストーリーは動画に軍配が上がります。わかりやすさは動画、網羅性は本だと思います。)

忙しい人も、この、Generalized Policy Iteration 回は見ていただけると嬉しいです! かなり整理になると思います!

第16章 クラスタリング

クラスタリングについては、この本を読めば OK というものは知りません。

みなさんも、必要に応じて検索し、ネット上の情報を総合して理解するのがいいかもしれません。

クラスタリングについては、そのうち動画シリーズを作成予定です。(早くて2026年くらい)待っててください!

紹介した分析モデルのみならず、スペクトラルクラスタリングなどは結構推し。この scikit-learn のクラスタリングのページが、多様な分析モデルが紹介されているので、おすすめ。いろいろ試したいときはまずここを見て、バリエーションを仕入れるのが◎

混合ガウスモデルについて、その変分推論を知りたい方(数学的にかなり重い)にはこちらの書籍はおすすめ。

書籍内の16.4節で紹介した、クラスタリングの適用例はこちら。

Wevox のデータを用いて、新卒社員のエンゲージメントの低下がグルーピングできることを見出しました。

(※新卒社員のエンゲージメントは、一部の企業を除き、基本的に下がります。何故ならば、労働環境の問題は想像つきやすいですが、過度な期待や根拠のない自信の喪失による部分も大きく、解釈は簡単ではありません。ネガティブすぎる解釈は危険なのでやめておきましょう。)

第17章 因子分析・主成分分析

とりあえずこれ見て!

因子分析と主成分分析の違いはこちら

書籍だと、初学者の方向けのものはあまり存じません、、、。

発展的な内容であれば、、、。

この本は、数式も読める人向け。因子分析の諸概念や、推定法の紹介と比較もあり、因子分析を極める上では非常に良い本です。

こちらの本は、主成分分析や因子分析のみならず、数量化理論等含め、線形代数で頑張る統計理論が多様に収録されております。いわゆる、『枯れた技術』が紹介されているので、ひとつ上のレベルを狙うデータ分析者の方におすすめです。(1980年代の古い本なので、最近のものほど読みやすくはないです。数式もしっかり入っています。)

これもおすすめ! こういうのから入りたい人は是非!

実は PRML にも載っているので、ツワモノの方はこちらもおすすめ。

第18章 上記以外の多変量解析たち

基本的に、この資料を調べても見当たらなかったから、やけになって頑張って調べてまとめたのが、この本であり、いろんな分析シリーズです。このシリーズ内に、たくさん分析モデルの動画があるので、参考にしてください

今日知りましたが、朱鷺の杜さんが非常に良い情報を集めてくださっているように見受けます。是非参考にしてみてください。

上で挙げたこちらの本にもいろいろはいっております。 (多変量解析法とは、統計的方法の基礎知識、線形代数のまとめ、単回帰分析、重回帰分析、数量化1類、判別分析、数量化2類、主成分分析、数量化3類、多次元尺度構成法、クラスター分析、その他の方法 ← こちらより引用)

アソシエーション分析は、アルベルトさんの資料を参考にしていたのですが、最近なくなってしまいました、、、。良い資料をご存知でしたらお教えください。それか、早く作ってください!

第19章 ベイズ系と構造方程式モデリング

ベイズ統計の基礎や、階層ベイズモデルといえば、緑本でしょう!

階層ベイズとは趣が違いますが、LDA 等で変分ベイズの話を知りたい人はこちらもおすすめ。(変分ベイズなどの、重たい積分計算が含まれています)

こちらの、変分ベイズの本もおすすめ。重たい、かつ、めんどくさい数式から逃げずに全部記述されており、非常に良い本だと思います。(ただし、完結、かつ、深い記述が、密度高く続くため、読むの大変 & 疲れる(褒め言葉))

構造方程式モデリング(= 構造方程式モデリング = Structural Equation Modeling = SEM)といえばこのシリーズ! そもそも、構造方程式モデリングは結構数理面が難しいので、なかなか大変ではありますが、理論を理解した上で使いたいならこのシリーズは本当におすすめです。

第5部 発展的回帰分析

第20章 多重共線性

線形回帰だけで345ページ6000円は伊達じゃない!

だいたいこれ読めば書いてあります。

配信中に、この本を教えていただきました。

P206 の図3.46がわかりやすいです!

stepwise regression とか LASSO とかは、多分この本で読んだ気がしますが、違ったらごめんなさい。(後日確認します)

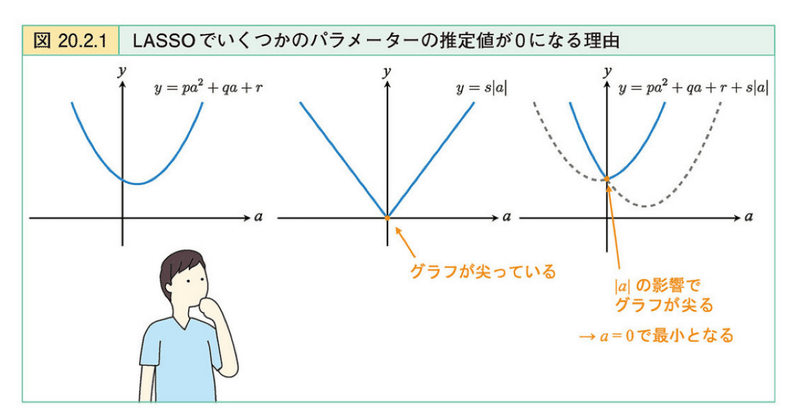

ちなみに、LASSO で変数選択できる理由、なんか、斜めの正方形と円が接している図がよくあると思いますが、ぶっちゃけ、あれ、説明になってなくないですか????

私はこの図の説明が好きです。

第21章 発展的な回帰分析

線形回帰といえばこの本! 回帰係数の区間推定など、回帰分析についてはほぼあらゆる事が書いてあります!!!!!

そんな分厚いの読めない人は、こちらがおすすめ。P225に区間推定の話が書いてあります。

誤差項の解釈といえばこれ! これを読んでいただければ、誤差に入っている情報がなにか、感覚で理解できると思います!

21.3~5の元ネタはこの本です。調整変数、交互作用項を用いた分析や、トービットモデル、ヘーキットモデルはこの本で勉強しました。回帰分析プラスアルファでここまで深い分析ができるのかと、ほんとうに驚きで、実務的な分析のアイデアもバンバン湧いてきます!

時系列分析については、この本が理論に非常に詳しいです。ARMAやVAR、共和分なども扱われています。

動画シリーズもあるので、時系列の参考にどうぞ(珍しく未完のシリーズですが、、、。)

手を動かす系でおすすめがあったらぜひ教えて下さい m(__)m

カーネル法については、オンラインの pdf と、何かの数学のイベントでの講演で聞いて理解を深めた気がします。

統計数理研究所の pdf がいちばん有名かと思います。

https://www.ism.ac.jp/~fukumizu/OsakaU2014/OsakaU_1intro.pdf

東大からも良い pdf が出ています。

カーネル法は、PRML 下巻にもあります。

まぁ、カーネル法は、はっきり言って理論は難しいので、そういうの好きな人のみ挑戦すると良いと思います!

この記事が気に入ったらサポートをしてみませんか?