【俺用メモ】SD Forge+SDXL環境で使えるControlNet【まとめ:lllite使え】

この記事ではStable Diffusion WebUI ForgeとSDXLモデルを創作に活用する際に利用できるControlNetを紹介します。なお筆者の創作状況(アニメ系CG集)に活用できると考えたものだけをピックしている為、主観や強く条件や用途が狭いため、他の記事や動画を中心に参考することを推奨します。

はじめに

どうもーこんにちは、カガミカミ水鏡です。最近(2024年3月時点)の画像生成AIは怒涛のゲームチェンジャーラッシュですな! 毎月言ってる? そんなことはないです隔月ペースくらいです。

まず1点はControlNetの作者としておなじみイリヤたんの新しいプロジェクト「Stable Diffusion WebUI Forge」(以下Forge)。従来のA1111 WebUIのインターフェースを保ちつつ内部処理をComfyUIみたいにして高速化を図ったもの。しかもA1111の資産でもある拡張機能も多くが互換性あり、移行もしやすいので全員にお勧め。俺がSD系UIの管理に使ってるStabilityMatrixでも、次のアップデートで対応!【2024/03/04追記】と書いた翌日にStabilityMatrixが2.9.0にアップデート!このバージョンからForgeを簡単インストールすることが出来るようになりました。モデルやLoRA・ControlNetも共通化出来るので便利!

もう1点は、animagine XL派生モデルの充実化と、pony diffusionの登場。animagineのクオリティは別の記事でもお話していて、その派生モデルも非常に優秀。美しく洗練された画像を出したいならオススメ。またponyは独特のプロンプト記法さえ覚えれば、イラストクオリティの調整と、質感のイラスト寄せアニメ寄せ海外カートゥーン寄せケモナー寄せなど、まるで10個くらいのモデルが1つに集約されたような全部盛りパッケージで非常に便利です。プロンプトの理解度も他モデルよりも頭一つ抜けており、現環境最強プロンプトわかりみ環境として名高いNovelAiDiffusion v3 に肉薄した印象です。

(おまけ) 最近のおすすめponyモデル

ちょっと話を脱線させますが、ついでにpony系と呼ばれる、pony diffusionから派生したモデル(以下pony系)で俺好みのものを3つ紹介しときます。元がクセ強の絵柄なので、こちら使う方がオススメ!

可愛い系を強化したmomoiropony

瞳の大きいSD1.5アニメモデルKIMIX./KIMAXをPonyで学習させたKIMXL(Pony) ※animagineXL版もあります

塗り感が特徴的なアニメモデルComradeship XL ※v5からPony系に

(おまけ) 最近のおすすめanimagine派生モデル

大人な女性が上手いイラストモデルYesmix XL(SD1.5版から使ってました)

SDXLに転向したことで遂に"呪い"から解放された伝説のイラストモデル Anything (万象熔炉) XL

で、この記事で使っていく、スッキリとしたアニメモデル AniEase

閑話休題、このSD forgeとpony系で使えるcontrolnetを調査してました。いやね、この前の記事で挫折した同人CGなんですが、最初はSDXLモデルを使ってたのですが、いざcontrolnetで体型調整したときに、使えなかったものが結構多くありましてん……だから頓挫した後、知識と環境をアップデートする必要性を再認識し、「俺がCG集を作る上で絶対に必要なControlnet」を調べあげる作業から始めることにしました。

そのためこの記事は「俺のメモ書き」という立ち位置で、検証自体はそれほど正確なものではありませんので、controlnetって何?とか思ってる方や、自分の作品の参考にしたいと考える方は、この記事を読む前に、他ブログや動画の情報を少し入れてから、この記事を軽い参考程度に流し見するのがベストです。

雑レギュレーション

バニーガールからバニーガールを生成します。この題材でないと俺のモチベーションが保ちませんでした。仕方ないよね。Controlnetに使う画像は、俺のモデル「TransisterDoll」で出力したバニーガールを使います。これは2.5次元よりも実写に限りなく近いモデルで、イラストよりも、Controlnetがこの題材をどう扱うかがよく分かるものになっています。但しこの画像を見てもわかる通り、かなり特殊な素材のため、定量的な評価として向かないというのはココが要因です。

その中からある程度複雑でかわいいポーズを選定。普段から大量に生成しとくと何かと便利ですよ、バニーガール。ただこの画像をXなどに投稿するとなると、主に谷間の問題から、センシティブ判定を受けるリスクが非常に高いです。それをControlNetと、プロンプト「full bodysuits」で改善しようという試みでもあります。 またピースサインも親指が辛くなるポジションになっていますね。このあたりの形状も維持されるか、それともプロンプトを理解し親指を曲げてくれるのかというのも注目。

Controlnetは青龍聖者さんのcontrolnet-llliteを使います。というか一番良かったしオススメなのがコレでした! llliteは他よりも軽量なcontrolnet実装とのこと。他の開発者の方もリリースされていますが、俺が必要なものだけが全て1ページに揃っておりダウンロードしやすかったことが要因。

モデルは先ほど紹介した、アニメ塗りが美しいAnimagineXL派生のaniease 1.4を使います。

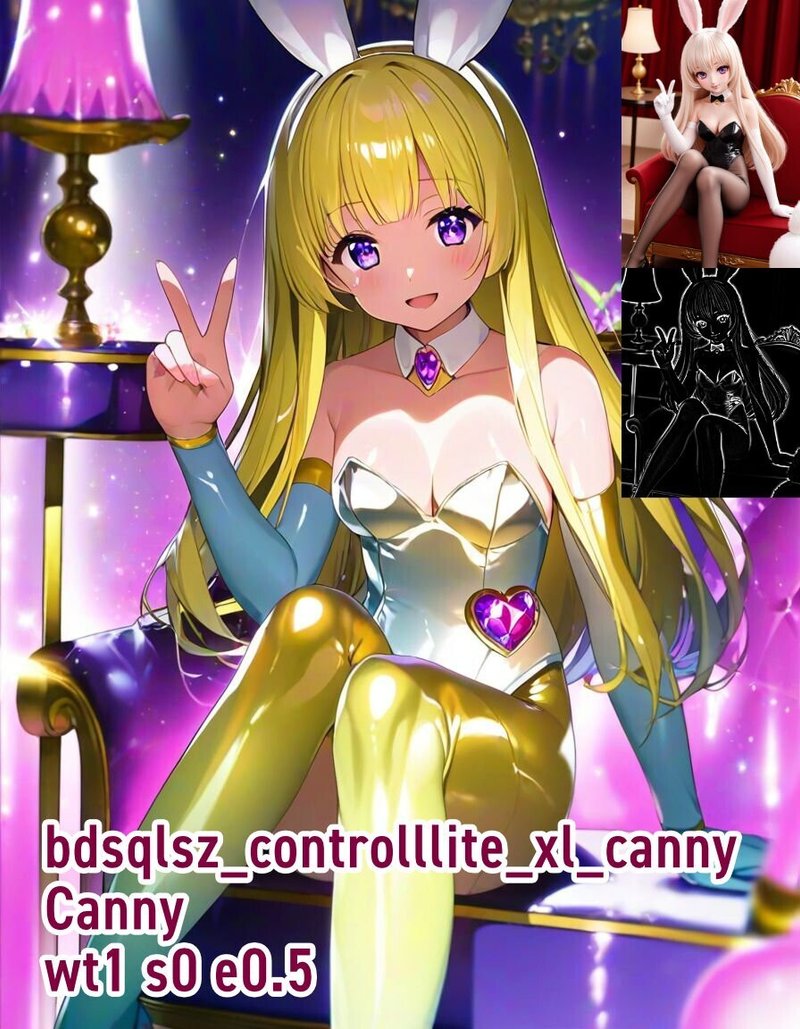

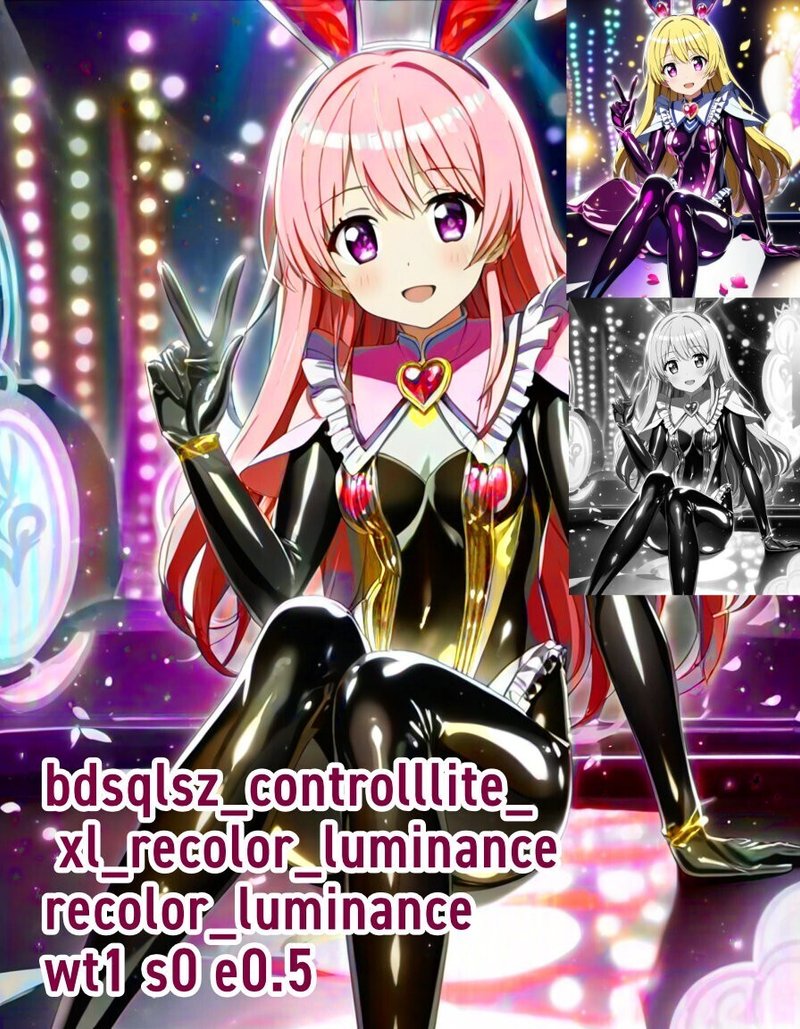

また作例画像には設定情報をオーバーレイで入れています。wtはweight、 sはstart eはendです。他の項目はフィーリングで理解ってください。

なお生成設定はこの辺です。SD Turboでstepsを10まで下げてるので相性の悪いモデルがあるかも知れません。

masterpiece, 1girl, (pri dream cure anime screencap:1.1) awesome top artist illustration, sailor senshi girl ,yellow hair blonde, sexy gravure poses, looking at viewer, zentai full covered bodysuits liked magical girl dress, showgirl skirt, rabbit ears, shiny latex fabric, (fusion lolita fasion and bodysuits with many frill:1.1), peace sign hand v ✌, torogao smile, (pastel color hair), (heart jewel), lure to temptation, narrow waist, light smile, open mouth, Shiny skin, in magical effect stage, SSR gacha effect, flower petal, large eyes big, cute beautiful eyes, detailed white pupil in eyes, raytracing, global illumination, detailed sharpness, ultimate quallity, bokeh, glistening clothes, reflective clothes,perfect anatomy, clothes reflecting light, extremely shiny clothes, ultimate quallity, extremely detailed thin line,most fav,highly rating, masterpiece,

Negative prompt: unaestheticXL_hk1, negative, noise, bad anatomy, bad proportions, worst, realistic, american cartoon, twisted fingers, jumbled hands, SD,breasts cleavage cutout

Steps: 10, Sampler: DPM++ 2M Turbo, CFG scale: 6, Seed: 3050283571, Size: 896x1152,

1 canny

安定の使いやすさ。ただし谷間は出ました。かなしみ。次からはもう少し強めにfull bodysuits着させます

2 depth midas

深度も定番ですね。ちゃんと着てくれました! depthの種類は他にもLeresやAnythingなどあるのですが、背景も深度を計測するか否かだと考えながら使うと良いでしょう。このmidasなんかは背景を無視する方ですね

3 lineart anime denoise

アニメ画像からアニメ画像を生成するのに向いている感じ。なので元が実写系の為、主線が不思議なことになっています。だけど……好き……

4 MLSD

元が建築用に用いられる、直線のみを認識する実装のため、だいぶ自由に作ってしまわれてますね。太腿の線を認識して維持したのはえらい!

5 Normalmap Normalbae

法線マッピングです。プリプロセッサのゲーミング感を維持してしまったのか、全部カラフルになりました……まっ、これも静物用ですね

6 dw openpose

openpose無印の方が有名ではあるのですが、商用利用やスポーツ不可などライセンス問題があります。一方顔の表情や手まで捉えるdw openposeではより自由なライセンス形態apache licenceの為、現在敢えて無印を使う必要はありません。上記のllliteでもdw openposeのみがありますね。 ……といいつつ使うと、座っている太腿が認識できず、全て立ち姿になりました。でも一番可愛い画像が出来て俺は幸せです

7 scribble_xdog

scribbleとsketchはほぼ同じ使い勝手と認識していいのかな。もともと太い線を描いてそこから画像を起こしていくものなので、先のcannyとかと同じ使い勝手で、期待できる結果を出せました。

8 scribble_pidinet

scribble系も安定ですね。イラストよりもアニメ塗りが合うと思います。……気づいてるかも知れませんが、weightやendを度々調整して、一番良い結果が出るものを紹介してます。もちろん参考程度にとらえ、ご自身の環境で調整して試してください。 なおstartをいじるシーンは……形状指定がメインの用途なら、あまり使わない……

9 softedge

ソフトの名にふさわしく線が柔らかい! レオタードの形状を維持させながらfull bodysuitsを着させろとおっしゃるクソクライアントの要望を受け止め、M82光の国から来訪したバニー星人のような衣装にしてくれました。わかってるじゃあないかッ!!

10 blur_anime

不勉強ながら試したことありませんでしたが、これ最高に良いですね! 特に背景をボカして主題を浮きだたせたい場合に非常に向きます。形態維持も非常に強い! 個人的には一番多用したいオプションかも!

11 tile anime

tileはプリプロセッサが元画像と同じなので掲載してません。 ……いやコレもすげえな! 元画像の殆どを維持したままアニメ化させました。谷間は……まあ可愛ければヨシ!

この辺になるとi2iみたいにも思えますが、ノイズ調整したi2iよりも元画像を維持させるのが上手い気がします。これ巧く使えば、画像をコラージュした際に画像をなじませる、という工程にも転用出来そう!

おまけ1 recolor_luminance

画像をモノクロにしてからプロンプト参照で着色するもの。こちらでは髪の色をredに変更しました。 他のパーツにも色の影響が及んでしまうのですが、ちゃんとやる場合は、i2i inpaintで髪の毛の部分だけマスクを掛けて、そこの色だけ変える、という方法がベターかと。

……と思ってi2i inpaint併用を試してみました。作例では右の🐰の髪色とスカートをピンク色にしました。なんだけど細部の塗りなどを考えると結構ガチャ要素高くなるので1パーツごとに実施した方が良いです。 手作業でのマスクだと塗り残しが発生したりするので、レイヤー管理できる画像編集ソフトがあれば併用するのが良いかなと思います。……あ、そもそもレイヤーを画像認識で選択する拡張ってあったような……?

あとちょっとだけハマりポイントがあり、inpaintで他画像との明度が変わったりしてたのですが、このcontrolnetでは「gamma」を指定できる形です。……でも他のソフトと違い、逆です。数値を下げると明るくなります。なんでやねん! とはいえ非常に有用で、色変更だけなら、普通のi2iだけでやるよりも形状を変更せず確実に着色できます。

おまけ2 reference_adain+attn

referenceは画像を参考に色々なポーズ形態で生成してくれるのですが、attn付きは姿勢制御までやってくれるみたいですね! これ素晴らしいのが、元画像の実写感をある程度維持してエナメルの光沢を再現してくれた事なんですよね……タイツの質感がリアルなのもそれが起因かな。……画像がハイキーなのは謎、もしかしたらプロンプトかもです……

おまけ2.1 reference_adain

……というわけで今度はアニメ系画像を使い、reference_adainにして生成。元の顔の描き方も、紫色のテカテカも維持しててえらい! ……しかしまあ、ハイキーになりますね……

……

もう恥も外聞も捨てて拡張機能に頼ることにしました。Vectorscope CCで生成前のノイズ時点で色調整をすることで生成後画像に反映できるという、謂わばStable Diffusionでもカラーグレーディングが出来るってやつですな。なお使ってるの俺以外に知りません。というかこんなマイナーな拡張機能でもSD Forgeでそのまま使えるのが素晴らしいですね!

おわりに

他、inpaintやinstant-ID系、PhotoMakerなどもあるのですが、紹介していません。この環境では上手く動かなかったのか、インストール方法が独特だったので凡ミスしたかは不明ですが、まあ使う用途も特にないかな、と。

俺的にはdw openposeが使えることが最大条件だったので、それを実現できたので実りのある実験でした! もちろんllliteなど昨年9月くらいからの技術ですが、その辺履修出来てなかったので、この機会に色々試せて、かつ失敗が減り生成が捗るようなノウハウがたまりました! やはりこういうのは自分で手を動かさないと理解できないので、皆さんも一度、自分自身が一番出したいお気に入りのプロンプトを入れて複数のcontrol typeを試して楽しんでみることを強く推奨します。俺もバニーガールだったから理解が深まったという印象です。自分自身の学習は、モチベーションが一番大事っすね。

また、極まった画像生成AI狂人の中には、例えば敢えてopenposeを使いたいとか、Segmentやinpaintモデルは別のものを使いたい、というのがあるかも知れません。その場合は以下のリンクが一番まとまっていると思いますので、参考にしてみてください。tencentのt2i adapterも従来よりも軽量化されているそうでオススメです。

さて、これで俺も心おきなく前回のCG集制作にとりかかれるというものです! さあ机に向かうんだ!

……

次回はSD Forge+SDXL環境で使えるiroiro-loraを紹介するかもしれない……

この記事が気に入ったらサポートをしてみませんか?