Live Extremeを支える技術

Live Extremeは2020年9月に「業界史上最高音質の動画配信システム」として発表させていただきました。「最高音質」を謳う根拠として、LPCM 384kHz/24bitやDSD対応など、対応フォーマットのスペックに基づいている部分もありますが、それらはLive Extremeの音質を司る一要素に過ぎません。今回はLive Extremeの概要と、その音質を支える技術要素について紹介していきます。

Live Extreme配信システムの概要

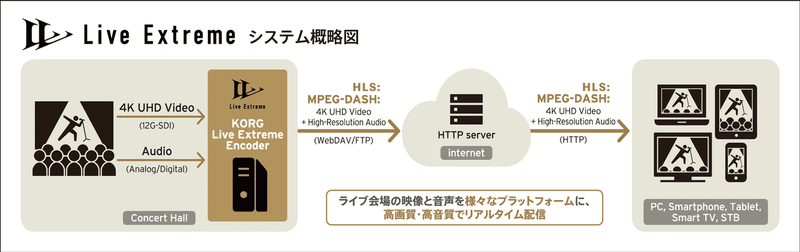

以下に、Live Extreme配信システムの概略図を示します。

一般にライブ配信を行うためには、配信業社がライブ会場に持ち込んで映像と音声をエンコードするためのライブ・エンコーダー、CDNを介してストリーミング・データを配信するための配信サーバー (プラットフォーム)、視聴者がストリーミング・データを再生するためのストリーミング・プレイヤーの3つが必要となります。Live Extremeも同様の構成となっていますが、私たちが注力しており、Live Extremeの音質の要となっているのが、ライブ・エンコーダーである「Live Extreme Encoder」です。

Live Extreme Encoderのハードウェア仕様

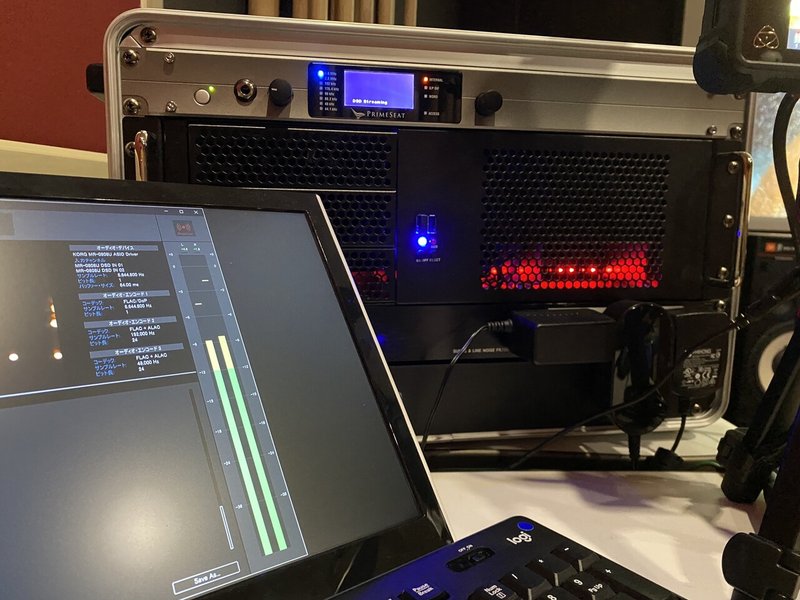

下図中央の3UサイズのマシンがLive Extreme Encoder本体となりますが、実はLive Extreme Encoderはソフトウェア・ベースで開発されており、このハードウェアも市販のPCパーツで組み上げたWindows 10パソコンに過ぎません。

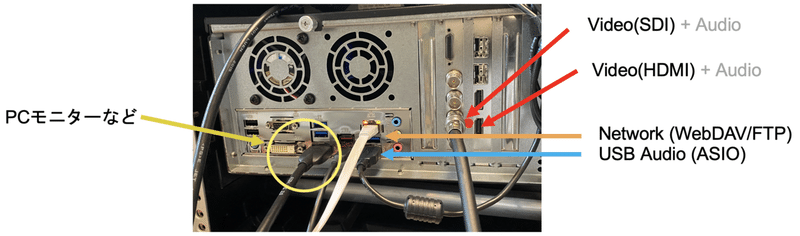

下図はLive Extreme Encoderの背面ですが、まさにデスクトップ・パソコンそのものであることが分かります。唯一普通のパソコンと異なるのは、映像のキャプチャ・カード (PCI Express) が刺さっていることで、12G-SDI端子またはHDMI 2.0b端子から最大4K/60fpsの映像を入力することができるようになっています。(エンコード対応は4K/30fpsまで)

Live Extremeの高音質化技術

Live Extremeはエンコーダーの入り口から出口まで、音が劣化する要素を極限まで排除することで高音質化を図っています。以下にそのポイントを列挙します。

1) ASIO対応オーディオ・インターフェイスへの対応

2) オーディオ・クロックを基準としたビデオとの同期

3) ロスレス・オーディオ・コーデックよる音声のエンコード

4) MPEG-DASH & HLS形式でのダイレクト・アップロード

このうち(2)~(4)は次回以降に順次解説するとして、今回は(1)について取り上げたいと思います。

ASIOとは?

Windowsで本格的なレコーディングを行う場合、通常は「ASIO (Audio Stream Input/Output)」ドライバに対応したオーディオ・インターフェイスをPCに接続して音声を入力します。ASIOは独Steinberg社 (現在はヤマハの傘下) が1997年規格したオーディオ入出力規格で、Windowsでは現在に至るまでデファクト・スタンダードとして広く使われています。(MacではOS X 10.3以降、Mac純正のCore Audioに取って代わられています。)

もともとはWindows XP時代のカーネル・ミキサーのレイテンシが大きかったことや、マルチチャンネル入力に対応していなかったことから、カーネル・ミキサーをバイパスするための規格として制作現場で重宝されていました。それが、ビット・パーフェクトでオーディオを伝送することを目的として、2010年前後よりコンシューマー・オーディオ (USB-DAC) でも広く使われるようになりました。

現在ではWindowsにも「WASAPI (Windows Audio Session API)」という仕組みがあり、レイテンシやカーネル・ミキサーの音質問題はほぼ解決していますが、少なくともレコーディング・ソフトウェア(DAW) の世界ではいまだにASIOが標準になっています。

ASIO対応オーディオ・インターフェイスへの対応

Live Extremeは他の配信システムと生い立ちが異なり、オーディオ専用のライブ配信システムである「PrimeSeat」を起点に、それに映像機能を付加したものとなっています。このため、その基本設計はレコーディング・ソフトウェア (DAW) のようなオーディオ的発想で作られています。

ASIO対応という点もその一つで、Live Extreme Encoderはオーディオ入力ソースとして、外部ASIOデバイスを接続して利用することができます。これには、MR-0808U, DS-DAC-10R, Nu IなどKORG製品はもちろんのこと、RME, MOTU, Focusriteなど他社製品も含みます。

動画ライブ配信にレコーディング・エンジニアが普段使っているオーディオ・インターフェイスを利用できることは、レコーディング・スタジオ品質の音をそのまま配信できることを意味します。(ビデオ・デバイスの貧弱なオーディオ入力端子では、残念ながらレコーディング・スタジオ品質は担保できません。)

また、過去20年間、多種多様なASIOデバイスが発売されていることから、

・アナログ (XLR, TRS, RCA, etc.)

・S/PDIF (coaxial, optical), adat

・AES/EBU

・MADI

・DANTE (Audionate Dante Virtual Soundcard経由)

など、配信現場の環境に合わせて、任意の入力フォーマットを選択することが可能です。

最近はミキサーにUSBオーディオ端子 (ASIOドライバ) が搭載されている場合も多いので、配信用ミキサーのバスをLive Extreme Encoderの入力として直接指定することも考えられます。

Embedded Audioへの対応

Live Extreme Encoderは、他社のライブ・エンコーダーと同様、SDIやHDMIに多重化された音声信号 (embedded audio) を配信することも可能です。もし、配信現場の環境が既にembedded audioを前提に構築されている場合は、この機能を利用することになりますが、音質の観点から積極的にお勧めしてはいません。

その理由の一つが、プロ・オーディオの専用機と比較して、ビデオ・デバイスのオーディオ入力端子が貧弱であることが多い (オーディオ性能について仕様が公開されていないことも多い) からですが、もう一点、クロックのジッタという観点からも、ビデオ・デバイスとオーディオ・デバイスを分離させた方が良いと考えています。

次回はこのあたりについて解説します。

この記事が気に入ったらサポートをしてみませんか?