VisionPro以後

ピピピッ・・・ピピピッ

電子音がする。アラームだ。寝ぼけ眼を擦りながらメガネを見る。

メガネの表面には、現在時刻が表示されている。

「げ、もう七時半!?」

布団から飛び起きてパジャマを脱ぐ。メガネをかけると、今日の最初の会議まで残り28分と表示される。

歯磨きをして、朝風呂に入りながら今日のニュースをチェックする。

寝てる間に何があっただろう?

「アイナー、AI関連のニュースは?」

メガネに映る画面の片隅に女性の形をしたエージェントアプリを呼び出す。

アイナー・・・AINaAは、Augmented Intuisive Navigator and Automatorの頭字語だ。

自作のもので、24時間新しいAIニュースやReplicateで公開されたAIをチェックし、評価し、報告する価値があると判断したものだけを選別する。

<<一時間ほど前に、10テラトークン長のペンタモーダルモデルが公開されました。音声、画像、テキスト、動画に加えて、心拍数の情報も学習させ、人間が感動するような3時間の映画を自動生成できるという触れ込みで、現在動作確認中です>>

「三時間の動画生成を一時間でチェックしたのか?」

<<はい。私は人間の1000倍速以上で動画を視聴可能です。数百本試したところ、性能はStableMultiDiffusion-XL2に2.5ポイント差、GPT-9に1.3ポイント差まで迫っています。商用利用可能ですがオープンソースではなく制限ありです>>

とはいえ腹が減った。

風呂を出て服を着替え、マンションから外へ出る。

会議が始まった。

歩きながら会議に参加する。会議の参加者は4名。いつもの定期報告で、基本的には聞いているだけでいい。向こうの画面には僕のアバターが表示される。初代VisionProにも最初から搭載されていた機能だ。

歩きスマホは危険と言われていたが、それは昔話だ。今は誰もスマホなんか持ってはいない。

歩きながら自分の正面に資料が投影されている。

軽く警告音が鳴り、資料が透けて道が見える。

道の向こうから太ったスーツの男性が僕目掛けて真っ直ぐに突っ込んでくる。新宿駅によくいる、ぶつかりおじさんだ。

僕はメガネはぶつかりおじさんの輪郭を囲み、短く警告する。

<<警告 衝突コース>>

僕は十分な余裕を持っておじさんを待ち構え、ギリギリでおじさんをひょいと避ける。僕にわざとぶつかってメガネの一つも落としてやろうと思っていたおじさんはバランスを失って道に転んだ。

僕は立ち止まり、道に転がったおじさんをじっと見る。

おじさんは慌てて両手で顔を隠す

「と、撮ってんじゃねえよ!!!」

<<迷惑行為を撮影 データベースに送信します>>

メガネに内蔵されたAIは、おじさんの顔だけ見ているのではない。服装、腕や手の長さ、掌に浮かぶ血管から脈拍、「撮ってんじゃねえよ」という音声。それらのものは危険行為・迷惑行為だと認識されると自動的にデータベースに保存される。もしも次におじさんが他の人に同じようなことをしようとすれば、最新バージョンのメガネ・・・Apple Vision 10 ProMaxを装着しているユーザーであれば事前に警告される。

この機能のおかげで最新のメガネをかけているだけで疎まれることもあるが、やましいことがなければ自分たちの身を守ってくれる大切な道具になる。

会議が終わり、友人と昼飲みする約束があったのを思い出した。

移動しながらメガネでKeynoteを開く。

「空間コンピューティングEXPOのブース企画。A社向け」

<<承知しました。A社の業務内容を踏まえた上で空間コンピューティングEXPOのブース企画を考えます>>

Keynoteにさまざまな案が組み上がっていく。

フロアプランが一つ、二つ、三つ、四つと生成された。

「ちょっと待って、B案のバリエーションが見たいな」

フロアプランの一つが選択され、ミニチュアの立体物としてゆっくり回転する。

立ち止まり、辺りを見回して安全を確認する。公園の遊歩道。ひと気はない。本当はやらない方がいいが、この欲求に勝てない。

「VRで見せて」

フロアプランが一瞬にして実物大に変わる。

「これはなかなかいいな・・・ここのパネル、もっと文字を大きく、極太明朝体にして、メッセージは違うのがいいな」

パネルのメッセージの候補が四つ浮かび、パネルの状態で周囲を漂う。一つを見つめて空中をクリック。選ばれたパネルがあるべきところに収まる。

よし、これで今度のVRプレゼンはうまくいくだろう。

「ワンッ!!」

犬の鳴き声が聞こえて、空間の一部が現実世界に戻る。犬の周辺だけ現実空間が表示される。程なくして飼い主の姿も現れた。

周囲で近づいてくるものがあればこうして自動的にVRが解除される。安全装置だ。最近は歩きVRはやめましょうという張り紙があるらしい。でも張り紙なんて、今どき誰が見るんだ?

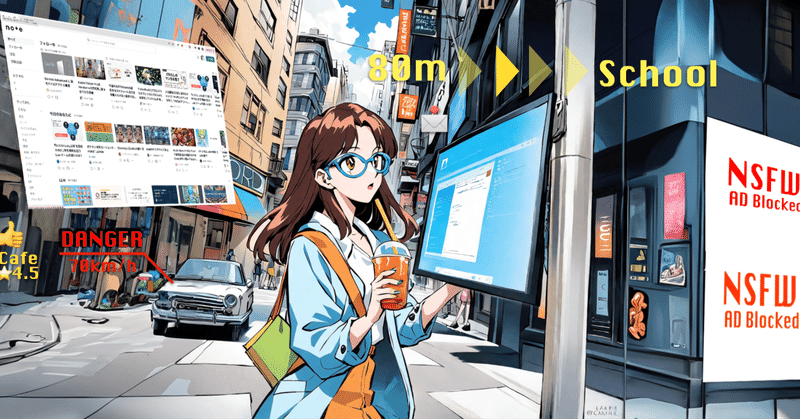

歌舞伎町を歩くと、いかがわしい広告を見つけアドブロッカーが起動し、「NSFW」と注釈をつけて見えなくしてくれる。見苦しいものは見なくていい。

歌舞伎町の店は入り組んでいて、一度行ったくらいではもう一度行くことさえ難しいが、メガネに詳細な道案内が矢印で表示されているからもう迷うことはない。VisionOS 15.6の新機能だ。

向こうから呼び込みが歩いてくる。

「お客さん、どこかお店をお探しですか?」

<<警告 このエリアでの客引き行為は法令で禁止されています>>

「鳥貴族に行こうとしてるんだけど」

目の前の人物は一見、優しそうな好青年で愛くるしい顔をしている。大学生のアルバイトだろうか。とても都条例に違反する行為をしているとは思えない。

「お客さん、鳥貴族ですか?あいにく今本店が満席で、系列店にご案内しますが・・・」

メガネが進化しても歌舞伎町は進化しない。

<<警告 このような誘いに乗るとは犯罪行為に巻き込まれる可能性があります>>

ウィンドウが表示され、近くの鳥貴族の混雑状況が表示される。平日の昼間なのに混雑してる。しかし、入れないというほどではない。その場で視線入力を使って予約を入れる。5分後に二名。

「予約があるんで」と、呼び込みをかわして先を行く。気がつくと矢印は三つ表示されていて、色が違う。赤の矢印は近いけど危険の多いルート。歌舞伎町にはそんな場所はいくらでもある。黄色の矢印はそこまで危険ではないけどできれば避けた方がいいルート。緑は遠回りだけど安全なルートだ。

緑の矢印に従って歩いていく。

メガネの普及によってテレワークの意味が変わった。通信可能範囲内ならどこにいてもいつでも会議できるし、仕事もできる。できないのは、気のおけない友人と酒を交わすことだけだ。こればっかりは、現地に行かないと話にならない。

目的のビルに来た。鳥族は五階だ。エレベーターに乗って五階のボタンを押す。

エレベーターを降りると、廊下にはスポーティなヘルメットを被ったUberEats配達員たちが並んでいる。結局こういうところはまだ自動化できてない。もしかしたらする必要もないのかもしれないが。

彼らの行列を掻き分け、奥にある目的の店にたどり着く。

店に入ると、店員姿のアバターがポップアップした。

<<いらっしゃいませ。奥のお席へどうぞ>>

席まで案内する矢印が表示される。

店内は客でごった返しているが店員の姿はない。猫型の配膳ロボットだけが右往左往している。

誘導された席に行くと、既に連れが座っていた。

「よ、元気してた?」

「ああ、もう頼んだ?」

「いや、まだだ」

空中にメニューが浮かぶ。

ハイボールがハイライト表示されていて、それを見つめ、クリック操作をする。

<<注文を承りました。しばらくお待ちください>>

程なくして配膳ロボットがハイボールを届けてくれた。

厨房には人が何人かいるのだろうが、今や店で人を見ることはほとんどない。

「最近気になるガジェットある?」

「あるある。今度Googleから出るらしいんだけど、これ見た?」

彼が空中で指を操作すると、こちらの画面に反応

<<空間シェアのリクエストが来ました。シェア開始しますか? YES/NO>>

YESを見つめて空中でクリック。

友人がシェアした空間アプリが空中に浮かぶ。

ごつい輪の形をしていて、ちょうどなかに頭が一つすっぽりと入りそうだ。

まるでそれは昔懐かしいヘッドマウントディスプレイのように見える。ただし、肝心のディスプレイ部分はない。VisionProから、ディスプレイを抜いてヘッドバンドだけにしたような状態。

「なにこれ?HMD?ヘッドマウントディスプレーじゃないよね?ディスプレーないし」

「これはHQD。ヘッドマウント量子デバイス。非接触型の量子センサーでなんだけど、脳のなかの量子状態をリアルタイムでスキャンできるんだ。もちろんメガネと一緒に使う。なに見ている時に脳にどんな変化が起きるのかをセンシングして、今みたいに選択肢を見つめて空中でクリックなんかしなくて良くなるのさ。考えるだけで全ての操作ができるようになる・・・らしいよ」

「へえ、バッテリーは持つのかね?」

「まだ最初の製品だからなあ。ただ、久々じゃん。こういう新しいガジェット」

「そうだね、VisionProが最初に出たのはもう10年前か・・・」

多分VisionProが開く世界、作ろうとしている世界はきっとこんな感じだろう。今は全然そこまで行ってないよ。でも10年後はたぶんこんな感じだと思う。

昨日、とある媒体から電話取材を受けて、「VisionProは危険性とかないんですか?大丈夫なんですか?」と聞かれて既視感を覚えた。ちょうど一年前、同じ媒体から「ChatGPTの安全性は?危険は?」と聞かれたからだ。今、ChatGPTについて真剣に心配してる人などいないだろう。考えるだけ無駄だ。

危険どころかむしろ便利になる。いかがわしい広告はブロックできて、ぶつかりおじさんや犯罪者は避けることができて、歩きスマホが危険じゃなくなるんだと(まあこれは本当かどうかはわからないが)。

VisionProの「現状」の機能やアプリだけを見てわかった気になるのは全くナンセンスだ。むしろこの新しい世界で、何が実現しそうか、何が自分にしかできない貢献なのか考えるきっかけになる。

この感覚は、iPhoneが登場した時に似ている。

いつも、本当に重要な変化が起きる時、ほとんどの人々が見逃すか、無視する。

何より素晴らしいのはVisionProは「非対称」のデバイスだ。つまり、「みんながVisionPro」を持っていなくても「俺だけがVisionProで無双」することができる可能性があるのだ。

昔の携帯電話の場合、相手も同じ会社の携帯電話である方が通話料が安かった。これは対称的なデバイスである。iPhoneは非対称なデバイスだった。相手が固定電話だろうがガラケーだろうがPCだろうがMacだろうが、誰とでもコミュニケーションすることができる。スティーブ・ジョブズが1995年に「インターパーソナルコンピューティング」と呼んだものの正体だ。

VisionProもまた非対称デバイスで、相手がMacでもiPhoneでもiPadでもFaceTimeで違和感なく(いや、多分違和感はあるがそのうち忘れる)コミュニケーションできるようになっているし、SMSやe-mailといった既存のデバイスも使える。VisionProの中でKeynoteやWordを使うことができ、その送付先は相手がPCでもMacでもiPadでもコンビニの印刷サービスでもいいようになっている。

iPhoneによって我々はパーソナルコンピュータを常に持ち歩けるようになったが、一つだけ大きな制約があった。それは空間的制約である。つまりiPhoneの画面はProMAXでも小さすぎる。iPadは大きいが、今度は重量的な制約がある。VisionPro初代は重たいしケーブルが不恰好だが、そこだけ除けば素晴らしいパーソナルコンピュータになる。Bluetoothキーボードを一つだけ持ち歩けばいい。これはHHKB Studioがもっと必要になる。何せ一台でキーボードとトラックポイントを搭載しているのだ。打鍵感覚はMacBookProよりいいし、何より全体の重量は減る。

VisionProをつけたまま歩くのは今のところ主に防犯上の心配がある。

何せ高級品だ。普通に強盗に迫られたら怖い。でもその不便を補うほどにVisionProには大きな可能性を感じずにはいられない。両手がフリーでコンピュータと一体化できる。コンピュータ、すなわちAIである。

スマートフォンはiPhoneが初めてではない。iPhoneは「最後発」のスマートフォンに過ぎなかった。最後発のスマートフォンが「新しいスマートフォン」の定義を作っただけだ。

VisionProは「最後発の空間コンピューティングデバイス」である。

そもそもHMDの歴史はパソコンの歴史と同じくらい古い。

アイヴァン・サザーランドが人類で初めて頭にディスプレイを装着したのは1966年のことだ。

動画を見ればわかるが、この頃からすでに「空間コンピューティング」への指向性が生まれていることは明らかだ。

ガラケービジネスで生計を立てていた僕がどうしてもiPhoneを無視できなかったのは、「それが世界を変えてしまう可能性」があったからだ。今となっては「iPhoneが世界を一変させた」のは既成事実だが、2007年にそうなるだろうと考えている人はほとんどいなかった。

その頃の僕のブログをログから回顧してみよう。

ちょうど日本ではiPhoneに先行してiPod touchが発売された頃のようだ。

ちなみに僕は北米のiPhoneは発売日にヤフオクで落札している。

以下、見づらい部分は編集してある

AUTHOR: shi3z

TITLE: いくらアップル好きでもこれはどうかと思う

BASENAME: 2007/09/23/204110

STATUS: Publish

ALLOW COMMENTS: 0

CONVERT BREAKS: 0

DATE: 09/23/2007 20:41:10

iPod touch、商品到着と同時にWinユーザーから不具合報告多数--「確認できていない」とアップル - CNET Japan

Windows版Safariのときも、日本語Windowsでまともにうごかないわ、サポートに問い合わせたら「動作確認用のWindowsマシンがないので確認できません」という対応には目を疑ったが、これはいくらなんでもひどい。

あらためて書くまでもないけど

・iPod touchはiPhoneが使えない国で先行メリットを提供するための戦略商品である

・iPhoneが使えない国、つまり米国以外で機先を制するのが至上命題

・世の中の大半はWindowsユーザーであるという事実

を考えれば、ここは絶対に外してはならなかったはずのポイントであり、Appleの世界戦略が不完全なまま「Apple = 米国以外では動作確認もせずに売る会社」という悪評が定着すれば、携帯電話の進化が数年は遅れてしまうことになる。

テクノロジーリーダーはその自覚を持って万全の体制で新商品を展開して欲しいし、また、仮に今回のような事態になってしまったときも各国支社は支給本国に連絡をとって正常なサービスを提供できるよう全力で努力するのが当然の対応であると思う。

これに関して未だに公式見解が発表されず放置状態のまま、ただiPod touchだけがユーザーの手元に続々と届けられる事態を看過しているのは完璧主義者のジョブスらしくない。

アップルの各国の支社がこの事態を「どうでもいいWindowsユーザーだけに出現する現象」と捉えていて、本国のスタッフは未だに寝ているんじゃないか(いまクパチーノは午前5時だしね)。

この比較は無意味だと思うけれども、これが日本の携帯電話だったらあり得ないような大事件だ。

F90Xシリーズはもう3年も前からiTunesと接続できるようになっているが、仮にこれがWindowsやMac、どちらでもいいけど接続がちゃんとできないとしたら、たとえ10000人中1人くらいしか使わないような機能であっても早急に対応策が出され、少なくとも公式見解は発覚してから5時間以内には発表されるだろう。

日本の携帯電話は特に電話法や電波法という非常に厳しい法律で守られていて、電話が電話として機能不全に陥るような事態を一切想定していない。

iPhoneで似たようなことが起きたら大事件だし、それはせっかく素晴らしい製品を作っても大多数の人にそっぽを向かれ、潜在敵対顧客を量産してしまうという最悪の事態を生んでしまう。

どんなに優れたテクノロジーがあっても、どんなに優れたデザインでも、顧客に失望されたらその事業は失敗する。それによって世の中の進化のスピードが遅くなるとしたらこれは業界全体にとって大きな衝撃となる。

僕はiPhoneに心から成功して欲しい。

素晴らしいハードウェァだし、それによって新しい次元のモバイル体験を作り出すことが出来る、未来への扉だと信じているからだ。

しかし今度のような失態を繰り広げていてはその未来は暗いと言わざるを得ない。

どうか早急に対策して、多くのユーザの信頼を取り戻して欲しい。

どれだけ真摯に、どれだけ迅速にこうした問題に対応できるかということが、アップルという会社の未来を決定すると言っても過言ではないと思う。

我ながら驚いた。なんと2007年の吾輩はiPhoneの将来を憂いていた。

まだ日本では発売もされてないし、それまでの携帯電話とは根本的に異なるものだからだ。

発売されたアメリカでさえトラブルが頻出していた。

その翌年、ついに日本でもiPhoneが発売される。

吾輩がどれくらいiPhoneの成功を願っていたのかはこの記事を読めばわかる。

しかしCNetすごいな。いつまでこの記事を保存しておいてくれるんだろうか。ちなみにこの時の行列こそがビッグウェーブさん誕生の場である。

近くにホテルと交代要員を携え、準備万端整え、日本で最初に発売されるSoftbankショップ表参道店に4日前から並んだ。

その発売当日の様子を3日後にこう振り返っている。長いので読み飛ばして良し

AUTHOR: shi3z

TITLE: iPhoneは電話じゃない

BASENAME: 2008/07/20/170545

STATUS: Publish

ALLOW COMMENTS: 0

CONVERT BREAKS: 0

DATE: 07/20/2008 17:05:45

iPod touch、またはiPhone 3Gは、携帯電話とノートPCの中間に位置するものだ。

これを携帯電話として語るのは間違いだし、ノートPCとして語るのは的外れだと思う。

これは携帯電話機能付きブレイクスルー・インターネットデバイスであり、インターネット機能付き携帯電話ではない。

夏野さんが「iPhoneみたいなものを作りたかった」という気持ちはよく理解できる。彼はもともとコンピュータオタクでありインターネットマニアだったわけだから、「ブレイクスルー・インターネットデバイス」を作りたかったのは間違いないだろう。そして事実、iモードはインターネットデバイスとしてひとつのブレイクスルーを産んだ。

けれどもiモードが最初からブレイクスルーインターネットデバイスであったなら、ここまでの普及はしなかっただろう。

あくまで携帯電話として売られ、ユーザが全く必要性を感じないうちにうまくインターネット機能を滑り込ませたことが成功の直接的原因だったと思う。

それに比べると、iPhoneは大上段に構えすぎている。Apple的な大袈裟な物言いは、多くのユーザから見ても反感を買うことが多いだろう。

iPhoneは「求めよ、されば与えられん」という機械である。

本当にそれを必要とする人にとっては手放せない、けれどもそうでない人にとってはどうでもいいものだ。

なぜそうなのか少し考えてみると、例えば携帯電話の場合、もって居ないと連絡が取れない。そして携帯電話というのは、そもそも単独では使い道がほとんど無い代物だ。

携帯電話に必要なのは対称性である。

携帯電話を使おうと思ったら、相手も使っていないと話にならない。

僕が大学に上がった頃、合コンでこんな会話は良くあった。

「ねえ、ケータイかピッチ(PHS)教えてよ」

「両方もってないんだ」

「えー、じゃあベルは?」

「ベルも」

「ホントに!?じゃあ電話番号」

「電話線ひいてないんだよね」

こういう人も生きていくこと自体はできる。けれども、合コンに参加しておいて連絡先が一切交換できないというのは、そもそも参加資格を持っていないのだ。いまなら「メールアドレス」も入るかもしれないが、インターネットよりもケータイの方が普及が早かった。

電話やポケベル、メアドなどは全て相手がいないと成立しない。いわば対称関係にある機械である。

しかしインターネットデバイスは、必ずしも対称ではない。

インターネットデバイスが対象性を持つのは、メールのやりとりくらいだ。

しかしメールの場合、同時性や即時性はさほど求められない。つまり携帯する必要がない。

携帯電話のメールが非常に短時間にたくさん交換される傾向にあるのは、メールが持つ性質ではなく、結果的にもっとも手近で心地よい手段が残っただけだと思う。ポケベルに似ている。

インターネットデバイス、たとえば情報ブラウザとして捕らえたときにiモードは必ずしも最適なものではない。この点で比較して、iPhoneとiモードには大きな違いがある。

iモードだけで探せる情報は少ない。

iPhoneではインターネットにあるほぼ全ての情報が利用できる。

今までノートPCを情報ブラウザとして持ち歩いていた人にとって、iPhoneが福音となるのはそういうことだ。

しかし、インターネットおたくでなければ、そこまで大量の情報を常に必要とするわけではない。

国内のたいていの面白いサービスは日本のケータイに最適化されており、PCで改めて読まなければならないようなものはほとんど無い。

情報の入力端末としては、携帯のキーパッドやノートPCのキーパッドにiPhoneは及ぶべくも無い。

何度かブログを書こうとしたが、少なくともはてなダイアリーを書くことはできなかった。あまりに遅く、しかもSafariが不安定で落ちる。はてなが悪いのかSafariが悪いのか、それとも僕のiPhoneの調子が悪かったのかイマイチ解らないが、一度でも消えてしまうともうやる気がなくなってしまうものだ

(中略)

インターネットデバイスは、要するに単方向なのだ。

孤独なデバイスと言っても良い。

相手が居ようが居まいが関係ない。

自分の必要とする時に、必要とする情報を得る。iPhoneは特にそれが顕著だ。

それが要するに「求めよ、されば与えられん」ということの意味である。

それは例えば無計画に行動する人間には非常に便利だ。

つまり僕である。

僕は休日になにかをしようというとき、全く計画を立てない。

ある日、暇だなあと思ったら友達に電話してみる。

「おい、今日ヒマ?」

「えーと、まあヒマかな」

「じゃあさ、なにか美味いもの食べに行かない?」

「どこに?」

「そうだなあ、中華街とかは?」

「いいね」

「じゃあ昼過ぎに君んちまで迎えに行くわ」

そして迎えにいって、それから何を食べるか考える。

「飲茶がいいかな」

「どっしりとしたものが食べたいね」

「点心が美味いところがいい」

「けど、男二人で行くんだからあんまり金のかからないところがいいな」

「じゃあネットで調べてみよう」

こういうときに、たぶんiPhone3Gは威力を発揮するだろう。

なにしろこれまで僕は、中華街に付いてからノートパソコンを取り出し、イーモバイルで接続して店を検索していたのである。これは少々間が抜けている。

もちろん、勘で「この店に入ってみよう」と思うこともある。

けど、それはとてつもないリスクを伴う。リスクを許容できる気分のときもあるが、年を取ると休日に中華を食べるというのは滅多にない経験だ。そのときリスクはなるべく減らしたい。

これがインターネットデバイスが便利であると実感できるときなのだけれど、実はこれはiPhoneである必要はない。

日本のケータイでもぜんぜん問題ない。

ぐるナビをはじめとしてさまざまなサービスがあるし、それを使えばいくらでも店を探すことが出来る。

ところで中華街の店をPCで探すときとケータイで探すときの違いはなんだろう。

ケータイで探す場合、あまりGoogleを使わない。

まずぐるナビを探して、そこから店を選ぶ。

ケータイだと、クリックして次のページに行くまでに時間がかかるので、あんまりたくさんの店を検討できない。

そのうち面倒になって「ここでいいや」と思ったりする。画像もあんまり見れないことが多い。これはケータイの性能が低いためでなく、ケータイの性能が低かった頃にサイトが作られたせいだ。

これに比べると、iPhoneやノートPCではより多くの店をたくさん比較検討できる。

もうひとつ、大きな違いは、iPhoneやノートPCでは複数のサイトを同時並行的に検索してどっちに行くべきか決められるということだ。

ケータイのフルブラウザでも出来るけど、処理が遅すぎてとても「こっちにするか、あっちにするか」選ぶという感覚ではない。少なくとも1秒以内に全ての情報が切り替えられないといけない。ケータイはその域にはとても達していない。

とはいえ、ある程度は許容できる。ある程度まではそれで十分と思える。そこまでの世界しか知らない人にとって、インターネットは情報過多なのだ。

要するに、たいていの人にとってデジタル放送とハイビジョンテレビとブルーレイが必要でないように、たいていの人にとってiPhoneやノートPCが必要でないのだ。

だから今すぐiPhoneが要るとか要らないとかは、大きな個人差がある。

ノートPCを情報閲覧のためだけに持ち歩いている人にとってはぜひとも必要だろう。

でもそうでない人にとっては全く不要なものだ。でかいだけで西村さんの言うように電話としては不便だし、カスタマイズもほとんど出来ない。

iPhoneを使う限り、iPhoneというライフスタイル、Appleというポリシーに制約される。

それが心地よい人もいるが、全く不快という人もいるだろう。

誰もがポルシェに乗ろうとするわけではない。誰もがポルシェに乗っているとしたら、今ポルシェに乗っている人たちは違う車に乗るだろう。

iPhoneはポルシェであり、ケータイはカローラだ。900シリーズの登場時に夏野さんは「900シリーズはアルファロメオ」だと言ったけど、実に的を射ている。つまり、「カッコいいイメージがあるけど、買えないほど高くはない」ものを目指したのだ。

実際、アルファロメオを運転する感覚は、トヨタとあまり変わらない。大衆車なのだ。

これがスポーツタイプのBMWやポルシェ、フェラーリあたりだと明らかに運転感覚が違う。

ハンドルは重くなり、車高は低くなり、路面の状況がうんざりするくらいステアリングに伝わってくる。

いちどランボルギーニ・ガヤルドを運転させてもらったことがあるが、耐えられないくらいに居住性が悪かった。カッコいいし、速いけど、運転は冷や汗物だ。

iPhoneがポルシェだとしたら、ティファニー携帯やプラダフォンはランボルギーニかもしれない。普通の人が買わないことにより高い価値がある製品だ。

国内において僕がiPhoneを歓迎する理由は、自分がまず使いたいということを別にすれば、新機能のネタがついになくなってしまった今の日本のケータイ業界において、次なる進化を促進するカンフル剤となってくれること。

それでも次の907シリーズで前面タッチスクリーンがすぐさま導入されるとは思わないが、iPhoneに刺激を受けない業界人が要るとしたら嘘だろう。

iPhoneに刺激を受けて、それを自分の仕事に活かせば良いのである。

iPhoneと全く同じものを作ることが不可能であったとしても(事実、不可能であると思う) iPhoneの良い部分を日本のケータイに取り入れて、iPhoneよりも現実的で、かつ日本人にとって便利なケータイを作ることは可能だと思う。

逆に海外に於いては、iPhoneに対抗する勢力が、たとえばAndroidなどで結束し、あの中途半端な実装をなんとか使えるものに進化させていく起爆剤になることを祈っている。

少なくともMicrosoftは刺激を受けているだろうし、次のWindowsMobileではとんでもない反撃を用意しているかもしれない。WindowsMobileはもともとタッチスクリーンが前提だから、iPhoneにあそこまでやられたら面白くないに違いない。

そういう意味でiPhone以前とiPhone以後は明らかに変化することが期待されるが、少なくとも国内市場だけを見て、iPhoneビジネスに参入する意味は殆ど無いはずだ。

iPhoneを礼賛する人の中に、日本のケータイ業界での経験がある人が殆ど居ないのは、要するにそれが「ネットのあちら側」のひとたちのためのデバイスだからだと思う。

エジケンにしてからが、「iPhoneは電話機能以外は殆ど使ってない」と言い放っていたじゃないか。

インターネット業界の人たちが、なんであんなに情熱的にiPhoneを語れるのかというと、要するにケータイというものを殆どつかっていなかっただけだと思う。

アメリカ人がiPhoneで初めてモバイルインターネットの素晴らしさに触れたのと似た衝撃をいまさらiPhoneから感じ取っているに過ぎないように思えてしまう。

もともと日本にあって見逃していたものを、海外の刺激で再認識するという、日本人の知識階級特有の「いつもの習性」が発動しただけに見えてしまう。

従ってあらゆる人がiPhoneに関して過剰に反応する必要はない。

中略

僕みたいな人にとっては、やはりiPhoneは福音なのだ。