24/03/29 音楽からダンスモーション生成できるEDGEを触ってみる

この記事は転載避けのために有料に設定してますが、ただのメモ書きなので、お金払う必要ありません。Twitterからリポストしていただければ無料で読めますので、無料で読んでください。

(”無料で読む"ボタンを押しても自動でリポストはされません。かならずTwitter画面を開いて手動でツイートをリポストしてください!)

最近はSunoでAI一発出しでイケてる曲が生成できるようになってきた。

しかし、このSunoで生成させた曲を3Dキャラにダンスさせたいなあと思ったらどうする?既存の有名曲なら誰かがモーションを配布してくださってる場合もあるが、今Sunoで作った曲だと自分で何とかするしかない。

とはいえ、自分でダンスを考案すると言っても私はダンスなんてやった事ないし、考案できたとしてもそれをモーションとして作るのは大変な作業である。

AIが曲から自動でダンスモーション生成してくれねえかなあ!

EDGEというダンスモーション生成AIを使うとそういう事が可能になるらしい。

EDGE: Editable Dance Generation from Music

まあいつも通り、とりあえず触ってみよう。

例によって、Windowsローカル環境への導入は他の方の素晴らしい記事があるのでそちらに任せる。こちらのおれっちさんが丁寧に導入をまとめてくださってるのでそれ見て導入してください↓

EDGE(Editable Dance Generation from Music)で遊ぶメモ|おれっち

基本的に記事のとおりにやれば上手く行くんだが、私の環境だと2点、問題があった。

まず私のPCはCuda12.2を入れてしまってるので、pyTorchのインストールをそれ用に変える

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121もう一点は何故かjupyter notebookが起動しない。これはググったらこちらの方法で直った↓

Jupyter Notebookインストール

環境設定のPathに以下のディレクトリを追加する(UserNameの部分は各自の名前に変える)↓

C:\Users\UserName\anaconda3\Scripts

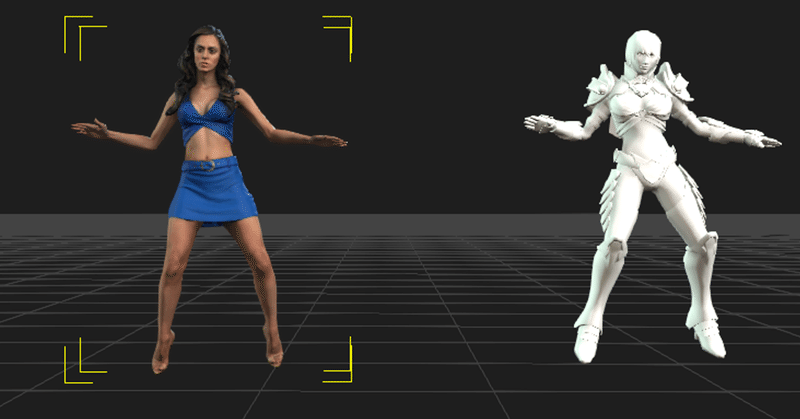

で、デモのnotebookを実行して出力されたFBXファイルをBlenderにインポートすると、なんかダンスするマネキンみたいなのが表示される。

ここから先は

この記事が気に入ったらサポートをしてみませんか?