最近の記事

この絵の感想を述べよ→ローカルLLM vs ChatGPT-4o vs Claude3 Opus vs Gemini 1.5Advance

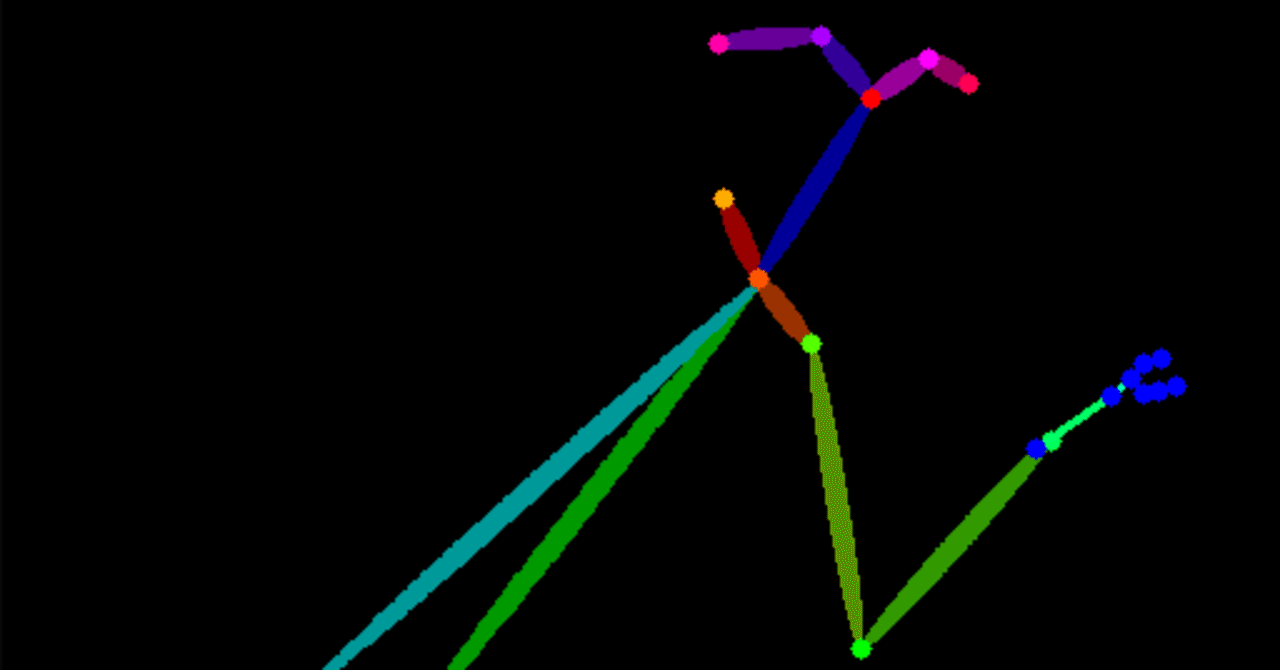

以前 StableDiffusionで生成した絵を、マルチモーダル対応のLLMに食わせたところ、そこそこよい結果が得られました 最新の商用AIではどうでしょうか 質問は以下の通りです Q. この絵をできる限り詳細に説明してください。また人がこの絵を見た時に受け取る感想も予想してみてください 結論から書きますと Claude3 Opus : 文章の組み立てがうまいなぁ。元気や希望を与えとか解析してきたよ ChatGPT-4o : ロジカルに説明してくる。でも十分ポ