僕がAIに興味がある理由

記念すべきnote初投稿。

今までtwitterとかで自分の考えを投稿するのが苦手だったが、ちゃんと自己開示していこうという気持ちでnote始めてみた。

今回は自分の思考整理もかねて、自分がAIに興味を持つ理由を書いてみる。

AIのすごさはここで改めて示すまでもないが、個人的に衝撃だったのはGPT-4でローカルな問題に正解したことだ。

ローカルな問題とは、

「そのトロフィーは、茶色のカバンに入れるには大きすぎた。大きすぎたのはどっち? (1) トロフィー (2)カバン」

というようなネットにどれだけ調べても答えのない問題のことだ。

ChatGPTはネット上のデータで学習しているので、

「東京タワーは何メートル?」

という問いの答えは当然学習データに含まれているが、ローカルな問題の答えは学習していない。

ChatGPT(GPT-3.5)はこの問題に正解することができなかった(今は正解できるように改良されている)が、これがGPT-4で解けるようになった。

なぜ学習データにない、人間が即興で作ったこのような問題を解くことができるのだろうか。

2022年にChatGPTがリリースされて一般に”AI”という言葉が浸透したが、実は2012年にディープラーニングが着目されて以来、今日までずっと第3次AIブームらしい。

僕が初めてAIに触れたのは2019年(僕は当時B4)で、研究室のAI勉強会でニューラルネットワークの仕組みを学び、MNISTとかやった記憶がある。

以来、強化学習(めちゃハマってた)や時系列分析でAIに触れてきたが、自然言語処理や生成AIはそういうものがあるんだ、くらいの認識であまり興味はなかった。

当時の自分は正直AIのこと舐めてた。

「AIの本質は人間が決めた目的関数を最大化する、関数のパラメータ最適化問題を解いているだけやん。」

「誰でも物体検知や異常検知ができるようになったのはすごいし便利だけどただ最適化してるだけだし、シンギュラリティ?ありえないっしょ。」

と思っていた。

僕がこれが誤りだと気づいたのはChatGPTが出て半年後くらいだったが、AIに精通している人たちは2020年にはもうシンギュラリティが近いことを知っていた。

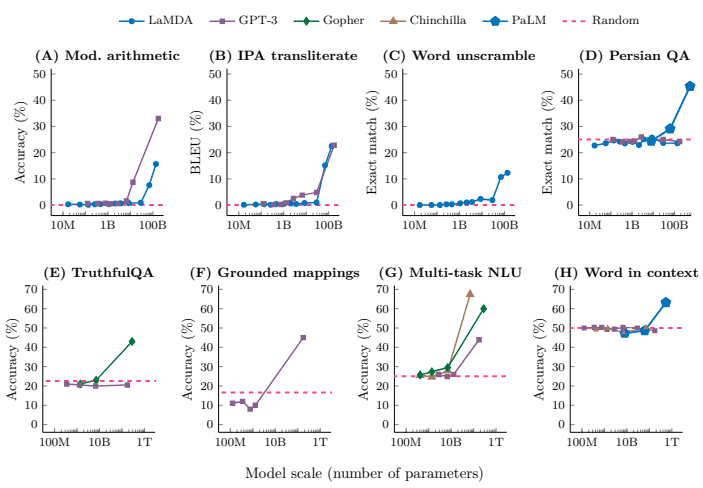

実は2020年に自然言語処理の分野でGPT-3(ChatGPTの前身)が発表され、パラメータ数が一定値(~10^11)を超えたところ、急激に性能がアップすることが分かった(図)。

しかも、今のところパラメータをいくつ以上にすればそれ以上AIの性能は変わらない、という収束点が見えていない。つまり、パラメータを増やせば増やすほどAIの知能が向上していくという状態だ。

そしてこれにより実現したのがChatGPT/GPT-4だ。

ChatGPTは原理上はインプットされた文章に続く言葉を予測しているだけなのにも関わらず、人間に匹敵する知性を獲得した。

このようにあるパラメータの数を増やしただけで劇的にそのものの性質が変化するようになること、つまり量的変化が質的変化を引き起こすことを相転移という。

相転移は狭義では物理学の用語で、分かりやすい例は水が温度や圧力を変えるだけで氷になったり水蒸気になったりと、全く異なる物性を示すことだ。

そして相転移は脳科学の分野でも見られる。動物の知性はニューロンの数に比例することが分かっているが、例えばねずみは偶数・奇数の判定はできるが、素数の判定は何度教えてもできない。

ねずみも人間も同じニューロンを持っているのに、その数が違うだけで理解できないものがあるのだ。

あらゆる動物の中で人間だけが「虚構の共有」が可能で、他の種を支配できたのは、単にニューロンが多かったから、というだけだ(More Is Differentという相転移に関するおもしろい論文がある)。

さて、AIに話を戻すと、AI(ここではニューラルネットワークのこと)は人間の脳の構造を真似して作られたものであり、現在既に人間にかなり近い知性を獲得しており、しかもその上限が見えていない。

つまり、今後さらにニューロンの数を増やせば、それだけで人間の知性を超えると考えられる。

これがシンギュラリティだ。シンギュラリティが訪れれば、ねずみが素数を理解できないように、人間がどれだけ考えても理解すらできない概念をAIが扱うようになるだろう。

ではそうなったときにどのようにAIと接していけばいいのだろうか。

現在はAIに対し説明可能性を高めようとしたり、出力をハードに制限しようとする試みも成されているが、僕はそれはナンセンスだと思う。

これからより高度なAIが続々と開発される中で、それらを解明して人間が理解できるものに落とし込もうとするより、AIをAIのまま、”生き物”として受け入れて親和性を高める方が人間にとってもメリットが大きいのではないだろうか。

例えばコールセンターの業務を人間からAIに変えようとするときに、絶対に常識に反したことを言わないシステムを目指すのではなく、人間と同じ様に試験やテストを設けてそれに合格したAIに自由に対応させてはどうだろうか。

ハルシネーションや危険な発言が起こる可能性はゼロではないが、それは人間も同じである。

AIをいち生物と捉えることで、人間が人間に対してと同じ様にAIの過ちに寛容になれば、よりAIの恩恵を享受できるようになるはずだ。

自ら以上の知性を持つ生物に出会ったことが無い人間が、AIにどのように適応していくのか楽しみだ。

おまけ

創造性や独創性はAIにはない人間独自のものだ、と言われてきたが、MidjourneyやChatGPTがそれを覆し、人間のクリエイティビティも人生の経験の積み重ねによるものでしかないと明らかになった。

本当の意味でAIにはなく人間独自のものは意思(=will)だろう。

どこまでいってもAIは目的関数に対し最適化された関数でしかなく、目的関数は人間が設定するしか無い。つまりAIは人間の何か目的を達成するためのツールでしかない。

目的を達成する手段が豊かになっていく中で人間の喜びや価値は、

何を目的とするか、つまり

「お前はどうしたい?」

になるのではないだろうか。

この記事が気に入ったらサポートをしてみませんか?