G検定 古典的なニューラルネットワーク

株式会社リュディアです。G検定 ニューラルネットワーク #2、G検定 ニューラルネットワーク #3、G検定 ニューラルネットワーク #4 で活性化関数についてまとめてきました。今回は古典的なニューラルネットワークについてまとめていきます。主に第2次AIブームの主役となったものです。

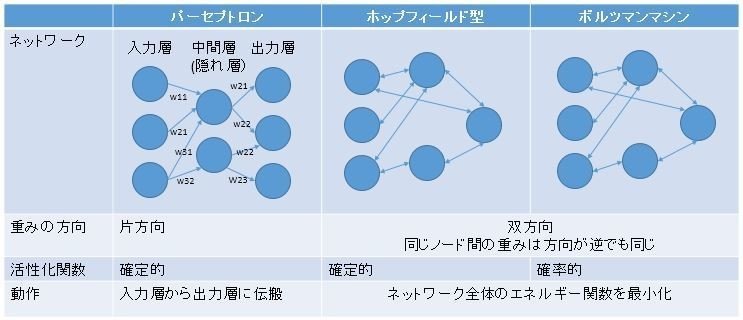

古典的なニューラルネットワークとしてパーセプトロン、ホップフィールド型ニューラルネットワーク、ボルツマンマシンの 3 つを取り上げます。パーセプトロンは単純パーセプトロンではなく、中間層ともつ多層パーセプトロンを扱います。まず概要をまとめると以下のようになります。

この図中のパーセプトロンは厳密には3層パーセプトロンと呼ばれるものです。入力層にデータを与え、出力層の値を確認しながら学習を行います。学習が終了したネットワークに、任意の入力を与えたときに学習結果に基づく結果が出力される、というものです。もちろん活性化関数であったり、重みの設定であったり、開発者あるいはユーザが設定すべき項目が多数あります。

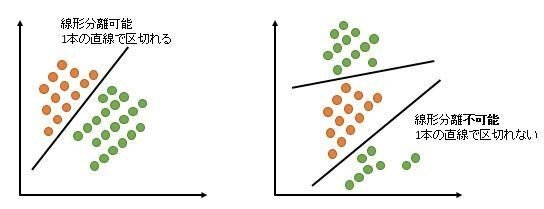

当初の単純パーセプトロンは2層構造であり、扱える問題が線形分離可能なもののみ、という事実が数学的に示されたことですぐに下火となってしまいました。単純パーセプトロンが線形分離可能な問題しか扱えないという事実はG検定でも頻出ですのでしっかりと頭にいれてください。線形分離可能という数学用語のイメージについてもよく問われます。以下の図のような2種の点の集合を1本の直線で分離可能かどうか、というイメージと一緒に頭にいれておいてください。

単純パーセプトロンは線形分離可能な問題しか扱えない、という限界はミンスキーとパパートによって示されました。特にミンスキーはAI界の大御所であり、大御所自ら第2次AIブームに対する期待が大きすぎることを示しAI冬の時代となった、ということも知っておいてください。詳細は以下の書籍にありますので興味のある方はどうぞ。

ホップフィールド型ネットワークは双方向の重みによりニューロンが結合されている点でパーセプトロンと大きく異なります。相互結合型と呼ばれるニューラルねとワークの一種です。ホップフィールド型のニューラルネットワークは以下のように動作します。

1. ニューロンを1つ選択し、そのニューロンへの入力値を求める

2. ネットワーク全体のエネルギー関数と呼ばれるものが定義され、エネルギー関数が小さくなる報告にネットワークの状態が遷移

3. 上記 1, 2 を繰り返すことで、ネットワークの状態遷移が進み、いずれエネルギー関数の値が一定、局所最適解になる。

ホップフィールド型ニューラルネットワークはネットワークに対しエネルギー関数を定義可能であり、エネルギー関数を目的関数とした最小化問題を解決する手法としても利用できます。

ボルツマンマシンはホップフィールド型ニューラルネットワークの状態遷移に確率的な動作を盛り込んだものと考えることができます。エネルギー関数が小さくなる方向ばかりではなく、確率にしたがってエネルギー関数が悪化する方向にも状態遷移することで局所最適解に捉えられないように動作するものです。

簡単ですが以上の 3 つが古典的なニューラルネットワークのまとめになります。G検定でこれらについて詳細に聞かれることは無いので簡単にまとめました。ボルツマンマシンが確率的な動作をする、ということは重要なので意識しておいてください。

では、ごきげんよう。

この記事が気に入ったらサポートをしてみませんか?