OBSでリアルタイム字幕・翻訳を出す

ワールドワイドな世界で、実況したり、バ美声(いわゆる、ゆかりねっと)をやったりすると、その次に出てくる問題は「どうやって話した言葉を他国語の方に伝えるか」ですね。

ゆかりねっとコネクターをつかえば、英訳とかできるわけですが、もっと合成をきれいにできたりしないかな・・・?とおもって、改良してみました。

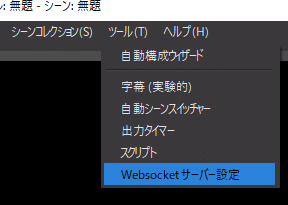

まずはOBS Studio自体に遠隔操作プラグインをいれる

OBS Studio には、遠隔操作のためのプラグインがあります。まずはこれをいれましょう。

うまくいけば、メニューが表示されます。

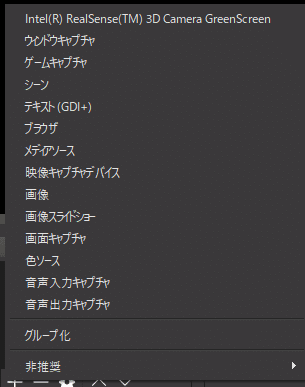

OBS Studioに字幕ソースをつくる

OBS Studioを起動したら、字幕用のソースをつくります。

この中から、「テキスト(GDI+)」を選びます。選んだら、名前を付けてください。この名前は後でつかうので、覚えておいてください。

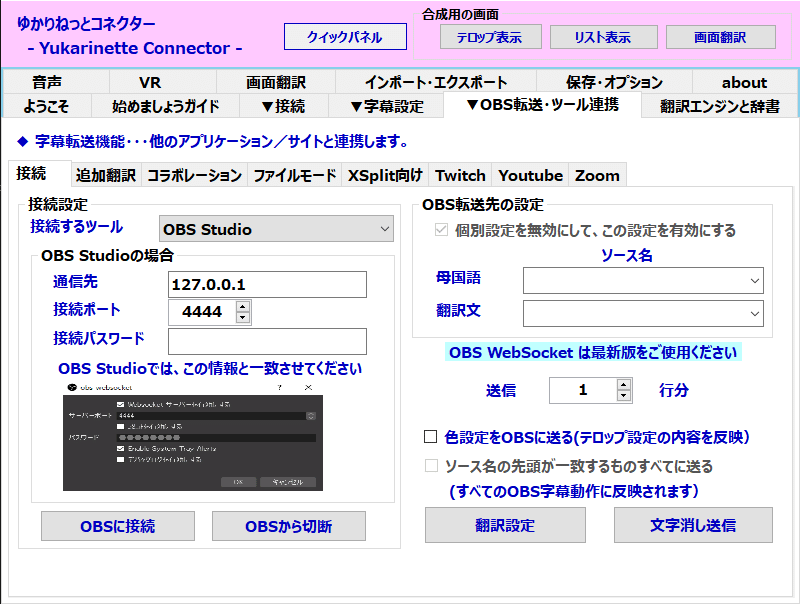

ゆかりねっとコネクターを設定する

ゆかりねっとコネクターを起動したら、字幕ソースの設定をします。

OBS Studio側に接続パスワードを設定しているようなら、パスワードをいれましょう。また、配信を別PCでやりたい場合は、通信先IPアドレスを対象のPCに設定すると良いでしょう。

設定が終わったら、「OBSに接続」をおします。うまくつながると、OBS側からリアクションがあります。

転送先設定は、母国語と翻訳文それぞれ設定できます。先ほど決めた字幕ソースの名前を入れます。OBSに接続ができていれば、選択肢から選ぶだけでOKです。(そのほうが打ち間違いがないです)

字幕合成支援で設定した色を使いたい場合は、色設定を送るチェックにレ点を打ってください。こうすることで、話者が変わったときに色を変えるなんてことができるようになります。

(フォントも変えたかったんですが、今のところOBS 側が受け付けてくれないので、送信を断念しました。いずれ再トライしたいとおもいます)

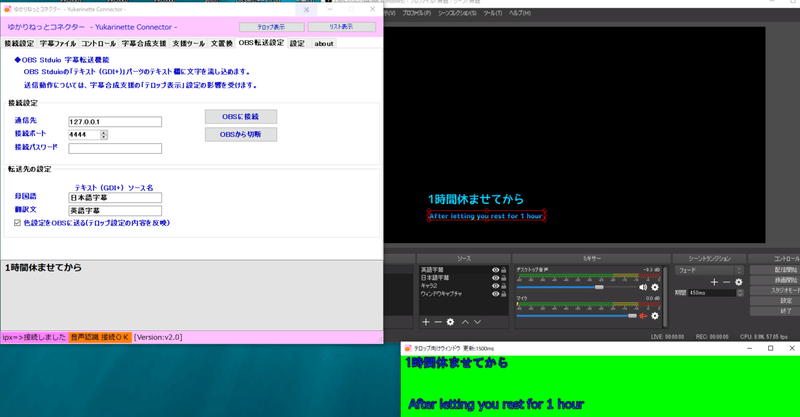

配信してみましょう

では、実際に音声認識させてみましょう。UDトークからでもいいし、Chrome音声認識からでもOKです。接続設定している端末から認識させてみましょう。

うまくいけば、認識結果がOBS Studioに転送されるはずです。

よりきれいに、より自由に

MacやLinuxで配信合成をしている方にも優しい設計になりました。フィルターとか使える分だけ、OBS Studioでの合成のほうが字幕はきれいですね。(しかも、グリーンバックを抜く処理だとちょっと文字が荒くなる気がするし)

ってことで、もっと自由になった ゆかりねっとコネクター、ぜひつかってやってください!

★翻訳システム契約維持のための支援もお待ちしております!

開発したり研究したりするのに時間と費用がとてもかかるので、頂いたお気持ちはその費用に補填させていただきます。