メディアは信頼を取り戻せるか

メディア・パブリッシャーが知っておきたい、次のトレンドについて掘り下げていくマガジンXimera MEDIA NEXT TRENDSの第6回となる今回は、メディアの信頼についてのレポートや関連するプロダクトを見ながら、未来を考えていきたいと思います。

本稿では、メディアが信頼を失っている背景とそれに対する動き、技術的な脅威が増しているフェイクニュースとその対抗策という観点で整理を図ってみました。

メディアは人々からの信頼を失っている

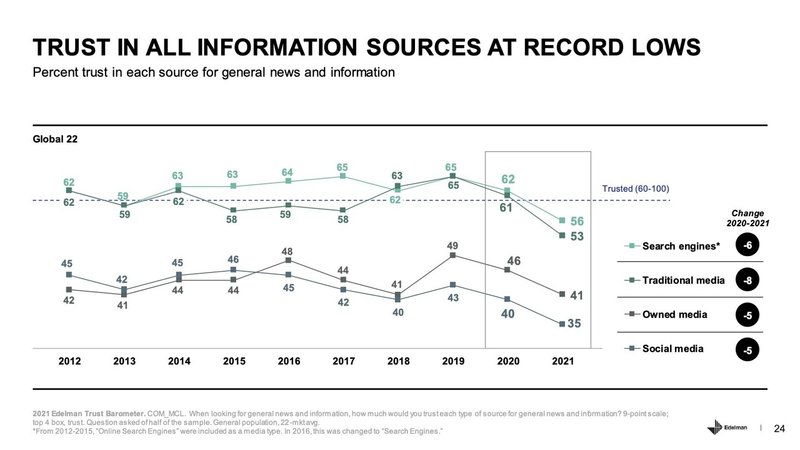

Edelmanが提供するTrust Barometer 2021の調査結果で、メディアや情報ソースへの信頼度は、検索エンジン、伝統的なメディア(マスメディア)、オウンドメディア、ソーシャルメディアのいずれもここ10年で最低の水準となりました。

画像出典: Trust Barometer 2021

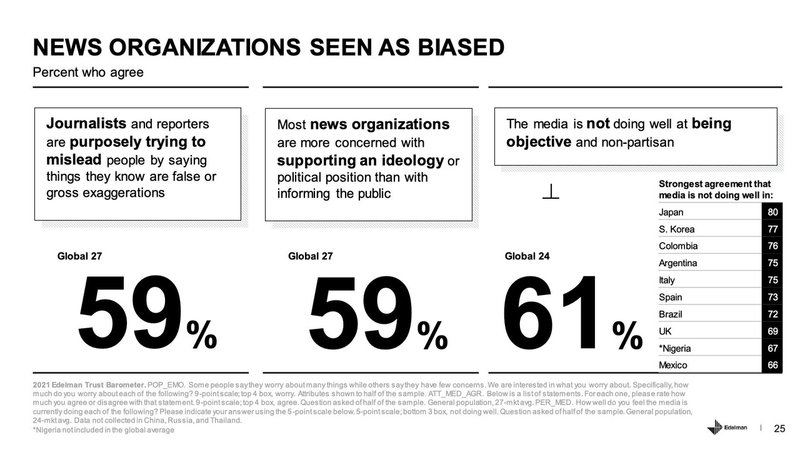

また同調査結果では、全体の約6割の回答者がニュースを発信する組織やメディアを信頼できないものとして位置づけていることが分かります。

画像出典: Trust Barometer 2021

上の図では、「ジャーナリストやレポーターは誤った認識や誇張の発信により、意図的に人々にミスリードさせようとしている」という主張に対して59%、「ほとんどの報道機関は人々に情報を伝えるよりも、組織のイデオロギーや政治スタンスにより関心が高い」という主張に対して59%、「メディアは客観的であり、狂信的ではないはずだが、そうなっていない」という主張に対して61%(日本は特に80%)の回答者が同意しているのです。

またAxiosによると、伝統的なマスメディアを信頼する人の割合も調査開始以来はじめて50%を割り込み、ソーシャルメディアにいたっては調査開始以来最低の27%という結果もわかりました。

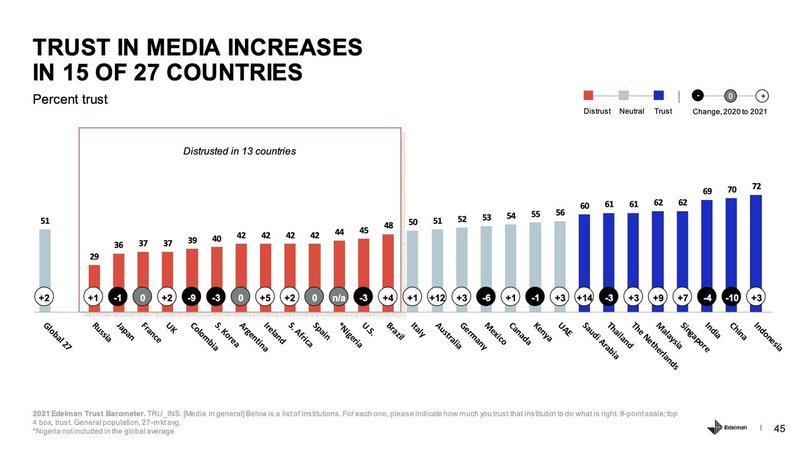

画像出典: Trust Barometer 2021

国別にみると、アメリカ、UK、韓国、フランス、スペイン、日本、ロシアはメディアを信頼すると答えた回答者の割合が半数以下でした。日本については、諸外国の中でもメディアを信頼する回答者の割合がかなり低く、わずか36%の回答者からしか信頼を得ていません。

メディアが信頼されなくなった背景には、国民の文化や習慣、各メディアの編集方針、パンデミックなどによる外的環境の変化などさまざまな要因が複合されているため一概に要因を特定するのは困難です。もし近年の情報技術による影響を挙げるとすれば、人々が入手する情報ソースのパーソナライズ化・断片化が進んだことにより、各個人が中立的・客観的な立場で考えることがしにくい環境ができあがっていることは、メディアの信頼性低下につながっているのではないでしょうか。

マスメディアではFox Newsのように政治的立ち位置が明確(共和党支持に大きく偏っている)なニュースネットワークがアメリカで最も人気を博し、インターネットでは特定のイデオロギーに偏った過激な活動を容認するサービスに人々がのめり込む現象が起こり、エコーチャンバー(偏った思想空間に長く接することで特定の信念が増幅されてしまう現象)が起こっているように思えます。

また、SNSに代表されるニュースフィードのアルゴリズムはパーソナライズ化が進みすぎた結果として、フィルターバブル(各ユーザの見たくない情報がフィルタされ、泡に包まれたような状況になること)に陥っており、これも同様に思想の偏りを起こす要因の一つとなっています。例えばTikTokフィードはアルゴリズムによって完全に制御されており、Twitterフィードについても自分のフォローしたユーザが発信する情報だけに偏っています。

偏った思想に対しては反動として昨今のParlerのApp StoreやAWSからの排除のように揺り戻しが起こりましたが、すぐに代替のサービスやアプリを見つけることができる環境もできあがってしまっています。例えばプライバシーを重視したフリーミアム型のソーシャルメディアであるMeWeはParler騒動後の2日間のみでUSで約11万の新規アプリインストールがあり、72時間で100万の新規ユーザサインアップがあったと伝えられ、一気にApp Storeの無料アプリカテゴリで10位以内へと入りました。このように人々は自身が好む思想やコンテンツが集まる場所に偏在するため、イデオロギーのエコーチャンバー現象を回避するのが難しくなっています。

フェイクニュースの脅威

メディアの信頼を脅かす要素としてもう一つあげられるのが、人工的に自動生成されるフェイクニュースです。今日では既に社会のあちこちにフェイクニュースが蔓延っている状況ですが、それを助長する可能性があるのが自動生成関連の技術です。例えば、文章の自動生成技術 (例: OpenAIのGPT-3)、DeepFakeによる顔画像や動画における顔のすり替え技術 (例: Synthesia)、合成音声技術 (例: GoogleのTacotron) などが近年次々に開発され、テキスト、画像・動画・音声のフォーマットでそれぞれ、高品質にフェイクニュースを生成できる下地が揃っています。

下記はスタートアップのSynthesiaによって製作されたサッカー選手のベッカムが9ヶ国語でマラリア撲滅を訴えるキャンペーン動画の舞台裏を解説した動画です。

この動画は英語以外のベッカムの動画はすべてAIによって顔画像を並べ替えることにより、リップシンク(唇の動きを話した言葉に合わせること)が実現され、あたかも英語以外の言葉をベッカムが話しているかのように見せています。なお字幕ではなくベッカムが話している形をとることでよりエンゲージメントを高める施策であり、悪意はありません。Synthesiaは倫理規則をオンラインで公開し、映像の基になった人物からは容姿を合成することについての正式な同意を得て、ビジネス利用に限ることや台本・アバターを事前に精査することで倫理を守ろうとしています。こうした動画を作ることは容易になってきており、悪意を持つ人物がフェイクニュースを作り、著名な人物に別の人間が好きなように主張を言わせたりすることも可能になっています。

メディアが信頼を回復するには?

ではメディアの信頼を取り戻すには、どういった方法論があるのでしょうか。例えば、ユーザが信頼できるニュースに接していることを認知し、自身の思想に偏向性がないかを再確認できるプロセスが提供されるべきです。

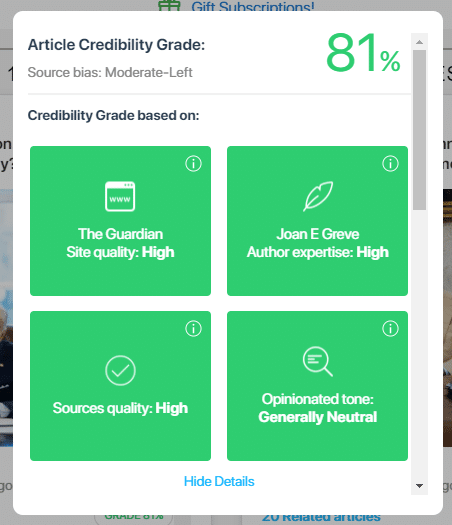

ニュースの信頼性を可視化するスタートアップであるThe Factualは、各ニュース記事に対して、(1) 引用元の確からしさ、(2) 記者の評価、(3) 記事が公開されているメディアの信頼性、(4) 政治的立ち位置 などを総合的に評価して記事毎に信頼度を割り出して表示しています。

The Guardianのとある記事は「中道/左寄り」で81%の信頼性

またトピック毎にサマリ、関連記事、右寄り/左寄りなど政治的立ち位置に応じたフィルターなども用意しており、記事を閲覧するための高い利便性も提供しています。記事の信頼度評価機能をChrome Extensionや検索サイトとしても提供しており、信頼に足るニュース記事かどうかをThe Factualのサイトに行かずとも知ることも可能です。

The Factualはまさに人々が客観・中立的にニュースを知るための手助けをしていると言えます。The Factualは月額5ドル(約500円)もしくは年額20ドル(約2000円)の有料サブスクリプションを提供しており、The Factualアプリの利用、デイリーの特選記事やレポートの提供、議論余地のあるテーマの論考/レポートなど、ニュースの信頼性評価を軸にしたマネタイズも模索しています。

The Factualの信頼性評価の方法は素晴らしいものの、完璧ではありません。ペイウォールがあるコンテンツはクロールできないため評価できませんし、画像、ビデオ、ツイートといったマルチメディアの引用についてもまだ評価モデルはできていない現状もあります。TechCrunchによると、疑わしい記事かどうか気づきを与えるのは読了後である方が効果が高いという研究結果もあり、どのタイミングでユーザに信頼性に気づきを与えるかというのも大事なファクターになりそうです。

いずれにせよThe Factualの信頼性評価のような方法は、メディアが信頼を取り戻す正しいやり方の一つだと考えられるため、今後メディア全体で議論されるような方向に向かってほしいと願っています。

フェイクを見破る技術

AIによるコンテンツ自動生成の精度は年々向上しており、今後一目では判別しがたいフェイクニュースが大量に作られ、人々が扇動されてしまう状況もありえます。ではフェイクニュースを見破る術はあるのでしょうか。

USスタートアップのTruepicは、クアルコムと共同で、画像や動画撮影された時刻と場所を正確にデータにタグ付けできるスマホ用カメラアプリを開発しています。撮影時にタグ付けをチップセットのセキュアな領域で実行し、あとから手を加えることができない状態で保存します。

このアプリで撮影された画像はタグから撮影時刻と場所に加え、編集履歴を調べたり、バージョン比較を通して信憑性を確認することができるため、ニュース組織や情報発信者が誤認やミスリードを防ぐことに役立ちます。特にソーシャルメディアなど一般の人々から情報が上がってくるケースには特にこうした検証が必要になってきます。

また、DeepFakeの検出ソリューションを提供するスタートアップであるSentinelは、TikTok、YouTube、Facebookなどのソーシャルメディアから学習用のDeepFakeを収集/DB化し、機械学習を使って画像や動画に変更を加えたメタデータを隔離することで音声変化(合成音声かどうか)を検出、フレーム毎の画像編集の検出を行った上でスコアリングすることで、DeepFakeかどうかを判定します(参考:TechCrunch)。

Sentinelが持つテクノロジーは政府機関やメディアに対して自動化されたデジタルメディア認証ソリューションとして提供されています。こうしたスタートアップが増えてきていることはフェイクニュースに対する脅威の裏返しでもありますが、真剣にこうした技術を早期に適用/運用しているメディアが信頼を勝ち取るという構図が予想されます。

おわりに

本稿ではメディアの信頼は大きく下がり、偏向メディアやアルゴリズムによる分断が起こっている状況をご紹介しました。現在起こっている課題は一足飛びに解決できるものではありません。ただ情報の提供者、受益者のどちらもがニュースの正しさとは何なのか、何を知るべきなのか、何を伝えるべきなのかを意識してプロダクトを使う/提供していくことが今まで以上に重要な時代に入ったと言えます。願わくば本稿がフェイクニュースに扇動されず、誰もが起こっている事実をベースにした議論ができる未来を考えるきっかけになればと思います。