産経新聞の報道に潜む誤り:ChatGPTの電力使用量を検証してみた

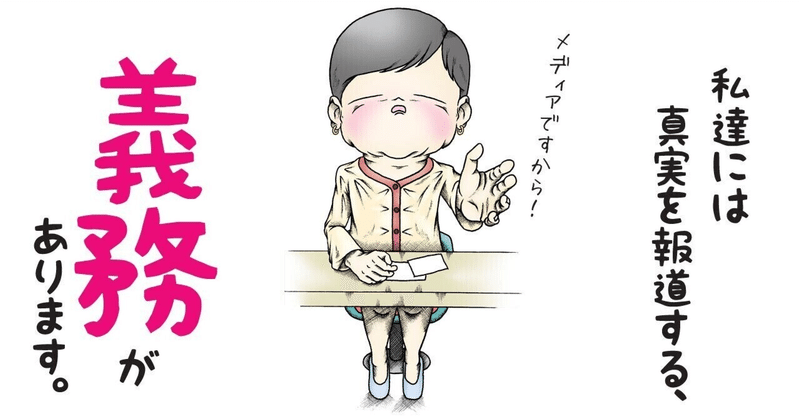

以下の記事は産経新聞の取材者が間違えているのか、NTT人間情報研究所が間違えているのか分かりませんが、『1時間当たり100万キロワット以上の電力を消費する』の部分は、kWとkWhとkW/hの区別がついていない人がやってしまいがちな間違いです。

<独自>NTT独自の省電力AI、11月にも発表 原発1基分電力消費のチャットGPTに対抗

2023/6/9 19:11

NTTが今年度中の商品化を目指して開発中の独自の生成人工知能(AI)について、今年11月のNTTの研究発表会で製品を発表する方向で検討していることが9日わかった。注目を集める米オープンAIの対話型AI「チャットGPT」は広範な分野の質問に回答できるが誤回答も多く、原発1基分に相当する1時間当たり100万キロワット以上の電力を消費するのに対し、NTTは金融や法律など各分野に特化して正確性を追求するほか、低消費電力という環境性能をアピールする考えだ。

NTT人間情報研究所の木下真吾所長が産経新聞の取材で明らかにした。

コンピュータは計算の負荷などの条件によって消費電力量は大きく異なりますが、富岳のようなスパコンはフルパワーで計算すると30MW程度の消費電力です。この場合、フルパワーで10時間計算を続けると、消費電力量は30MW×10時間=300MWhになります。

平均70%の消費電力で24時間×365日稼働すると、30MW×70%×24時間×365日=183,960MWh(約184GWh)が富岳の年間消費電力になります。

ChatGPT-3.5と3では異なりますが、ChatGPT-3.5のトレーニング期間は28日で、ChatGPT-3のトレーニング期間は30日くらいと推定されています。

ChatGPT-3のトレーニングには30日間で10GWh (10,000MWh)掛ったと想定されているので、10,000MWh÷24時間÷30日≒14MWの消費電力になり、富岳よりも若干消費電力の少ないスパコンを使っていると推測できます。

1GW出力の原発は一時間当たり1GW=1,000MW出力なので、ChatGPT-3が使ったメインフレームの一時間当たりの消費電力が14MWだと、当該記事は1,000MW÷14MW≒71倍も間違っていることになります。

OpenAIがChatGPTの消費電力を公表していないことについては、一部のアメリカのクオリティー誌から批判されています。然しながら、サーバーの100%をChatGPT-3.5や4のサービスに使っているわけではなく、実際のサーバーの運用率は、ユーザの利用状況や、新しいモデルの実験やトレーニングやメンテナンスなどの条件によって毎時間異なっているので、説明し難いといったOpenAIの内情は分からなくもありません。

そこで、論文や報道などからわかる範囲で分かる消費電力の情報を提供すると、以下のような感じです。

ChatGPT-3のトレーニングには、約10GWhの電力が必要でした。

ChatGPT-4のトレーニングには、約1.287GWhの電力が必要でした。これは、ChatGPT-3の約八分の一に相当します。

ここで注意が必要なのは、ChatGPTが3から4にアップデートして計算効率が8倍になったという意味ではないことです。 実際にはChatGPT-3でトレーニングしたデータを蒸留(トレーニング済みの情報を抽出することを蒸留と言います)して、移植できるようにしたのでトレーニングの作業量自体が少なくなっていることが主な原因です。

この記事が気に入ったらサポートをしてみませんか?