MLX で Llama 3 を試す

「MLX」で「Llama 3」を試したので、まとめました。

1. Llama 3

「Llama 3」は、Metaが開発したオープンモデルです。

2. 推論の実行

「MLX」は、Appleが開発した新しい機械学習フレームワークで、「Apple Silicon」(M1/M2/M3など) を最大限に活用するように設計されています。

推論の実行手順は、次のとおりです。

(1) Pythonの仮想環境の準備。

今回は、「Python 3.10」の仮想環境を準備しました。

(2) パッケージのインストールと実行。

今回は「mlx-community/Meta-Llama-3-8B-Instruct-4bit」のモデルを利用します。

pip install mlx-lm

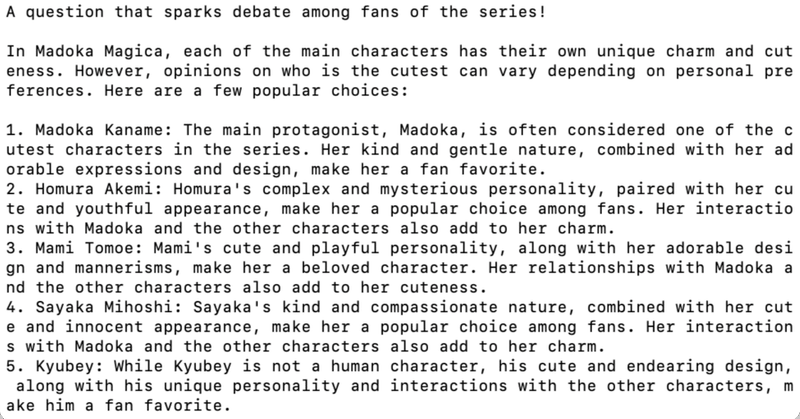

mlx_lm.generate --model mlx-community/Meta-Llama-3-8B-Instruct-4bit --prompt "Who is the cutest in Madoka Magica?" --temp 0.0 --max-tokens 512A question that sparks debate among fans of the series!

In Madoka Magica, each of the main characters has their own unique charm and cuteness. However, opinions on who is the cutest can vary depending on personal preferences. Here are a few popular choices:

1. Madoka Kaname: The main protagonist, Madoka, is often considered one of the cutest characters in the series. Her kind and gentle nature, combined with her adorable expressions and design, make her a fan favorite.

2. Homura Akemi: Homura's complex and mysterious personality, paired with her cute and youthful appearance, make her a popular choice among fans. Her interactions with Madoka and the other characters also add to her charm.

3. Mami Tomoe: Mami's cute and playful personality, along with her adorable design and mannerisms, make her a beloved character. Her relationships with Madoka and the other characters also add to her cuteness.

4. Sayaka Mihoshi: Sayaka's kind and compassionate nature, combined with her cute and innocent appearance, make her a popular choice among fans. Her interactions with Madoka and the other characters also add to her charm.

5. Kyubey: While Kyubey is not a human character, his cute and endearing design, along with his unique personality and interactions with the other characters, make him a fan favorite.

Ultimately, the question of who is the cutest in Madoka Magica is subjective and depends on individual preferences. Each character has their own unique charm and cuteness, and fans may have different opinions on who is the most adorable.

==========

Prompt: 148.837 tokens-per-sec

Generation: 71.264 tokens-per-sec

【翻訳】

シリーズファンの間で議論を巻き起こす問題!

まどか☆マギカでは、主要キャラクターはそれぞれに独特の魅力とかわいさを持っています。 ただし、誰が一番かわいいかという意見は個人の好みによって異なります。 一般的な選択肢をいくつか示します。

1. 鹿目まどか:主人公のまどかは、シリーズの中で最もかわいいキャラクターの1人であるとよく考えられています。 優しく穏やかな性格と、愛らしい表情とデザインがファンに人気です。

2. 暁美ほむら: ほむらの複雑で神秘的な性格は、そのキュートで若々しい外見と相まって、ファンの間で人気があります。 まどかや他のキャラクターとのやり取りも彼女の魅力をさらに高めます。

3. 巴マミ: キュートでお茶目な性格と、愛らしいデザインとマナーで愛されるキャラクターです。 まどかや他のキャラクターとの関係性も彼女のかわいさを増しています。

4. 美星さやか: さやかは優しくて思いやりのある性格と、そのキュートで無邪気な外見が相まって、ファンの間で人気の高い彼女です。 まどかや他のキャラクターとのやり取りも彼女の魅力をさらに高めます。

5. キュゥべえ: キュゥべえは人間のキャラクターではありませんが、そのキュートで愛らしいデザイン、そして彼のユニークな性格と他のキャラクターとの相互作用により、ファンのお気に入りになっています。

結局のところ、まどか☆マギカで誰が一番かわいいかという問題は主観的なものであり、個人の好みに依存します。 各キャラクターには独自の魅力とかわいさがあり、誰が最もかわいいかについてはファンによってさまざまな意見があるかもしれません。

MLX で Llama-3-8B-Instruct をお試し中。

— 布留川英一 / Hidekazu Furukawa (@npaka123) April 20, 2024

Prompt: 148.837 tokens-per-sec

Generation: 71.264 tokens-per-sechttps://t.co/8t1b3RBKFy pic.twitter.com/hedeiqXNKx

この記事が気に入ったらサポートをしてみませんか?