4月25日 2022年版『ポートピア連続殺人事件』は欠陥だらけのゲームだった

AIは非搭載でした。

以前にも紹介した、スクウェア・エニックスが実験的に制作したゲーム『ポートピア連続殺人事件』がSTEAMにおいて公開された。

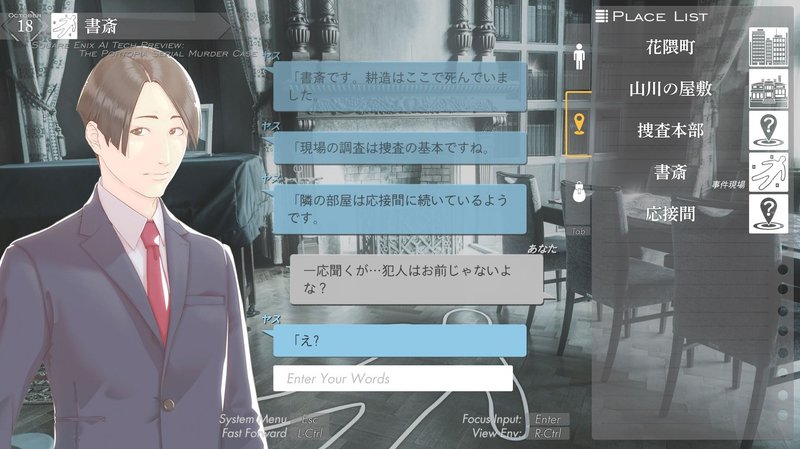

この作品は「CEDEC+KYUSHU 2022」というイベントのなかで発表されたゲームで、あくまでも「実験的」なもの。このゲームには自然言語処理(Natural Language Processing)技術が活用されていて、こちらが何気なく入力した言葉をAIが読み取って、その場面にあった回答をしてくれる……というもの。

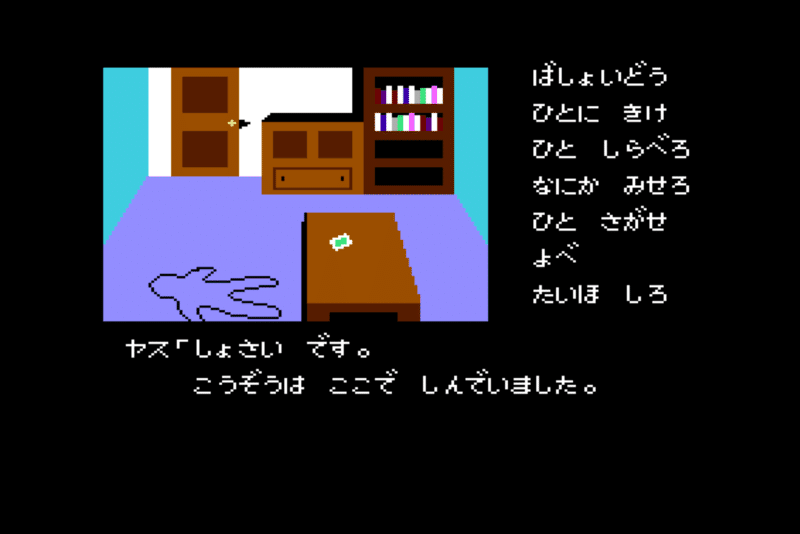

そこでどうして1983年のアドベンチャーゲーム『ポートピア連続殺人事件』が題材にされたのか? 1980年代のアドベンチャーゲームというのは実は「自由入力」式のゲームだった。しかしそれは、制作者が意図したとおりの文言を、1字の誤りなくピタリと入力しなければならないゲームで、プレイヤーが「こう進めたい」と思っても、その文言を見つけ出さないと進めることができない……というものだった。それは毎回のシーンでパスワードを探すようなものだった。この「自由入力式」のアドベンチャーゲームがこの時代の主流で、『ポートピア連続殺人事件』もその流れに乗ったものだった。

しかし当たり前だけど「自由入力式」のゲームはおそろしく敷居が高い。当時のアドベンチャーゲームは相当の「通」でないかぎり、誰も手を出さないジャンルだった。そこでとある革命的なゲームの登場によって、「コマンド選択式」がアドベンチャーゲームの主流になる。それが1984年のファミコンで発売された『オホーツクに消ゆ』だった。1985年に『ポートピア連続殺人事件』もファミコンに移植されたが、その時に「コマンド選択方式」が採用される。いずれも後に『ドラゴンクエスト』という国民的RPGを生み出すことになる堀井雄二さんの作品である。

その以前の、あまりにも難しくてほとんど誰も手を出せなかった「自由入力型アドベンチャーゲーム」をAIの力を使って、むしろ便利に、自由入力であればよりロールプレイとして理にかなったプレイングが可能になるのではないか。 そこでファミコン移植時に「コマンド選択方式」にされていた『ポートピア連続殺人事件』をあえて「自由入力式」アドベンチャーゲームに戻す。ただしAI搭載の最新のゲームとして。それが今回実験的に制作された2022年版『ポートピア連続殺人事件』だった。それは40年越しの課題に挑戦するゲームであった。

スクウェア・エニックスにはAIを研究する独自の部門があり、その成果としてイベント内で実験的に発表し、それで終わるはずだったゲーム……それが2023年4月24日にSTEAMにおいて無料配信される。

これは是非やらなくては! 「CEDEC+KYUSHU 2022」の技術デモのレポートを見ていたから、いったいどういうものなのか、体験してみたかった。

……が!

残念ながら自然言語生成(NLP)は本作において未搭載。

というのも自然言語生成(NLP)には「未解決の技術問題」があって、それはまだ商品にならないから、今回は搭載が見送られた。

どうして未搭載なのかというと……現実の倫理的・権利的な問題のある文章を生成してしまう危険性があるから……という。ゲームに関係ないあらゆる話題に対応できるけれども、それはそのゲームにおける世界観とはまったく関係ない話題までしてしまう……ということでもある。例えば本作の世界観は1983年だが、しかしシステム上、話題を投げかけられるとネット上のあらゆる情報を参照のうえ、答えを返してくれる。そうするとキャラクターが未来の話題まで話し始めてしまう。

(そもそも1983年にはインターネットなど存在しておらず、いくらAIが1983年頃のできごとを検索した上で答えたところで、今の時代ほど豊かな答えは用意してくれないだろう)

現実の事件や政治問題の話題になると、かなりデリケートな問題を孕む。例え「正論」であっても、見る人には「問題だ」と写るのが今の時代だから、その部分だけ切り抜かれてSNSで拡散されて、販売者の責任になったら……。

そうならないように、「明らかに関係ない話題」「そのキャラクターが知り得ない話題」「世界観を壊すような話題」は回避する回答をしなくてはならないのだけど……。どうやったらそれが実現できるのか、というところまでこの技術を突き詰められていない。これが未解決の技術問題。

そういうわけで自然言語生成の搭載が見送られてしまった。

一番の注目ポイントを欠いたまま……いったいどうなってしまうのか。とりあえず遊んでみよう。

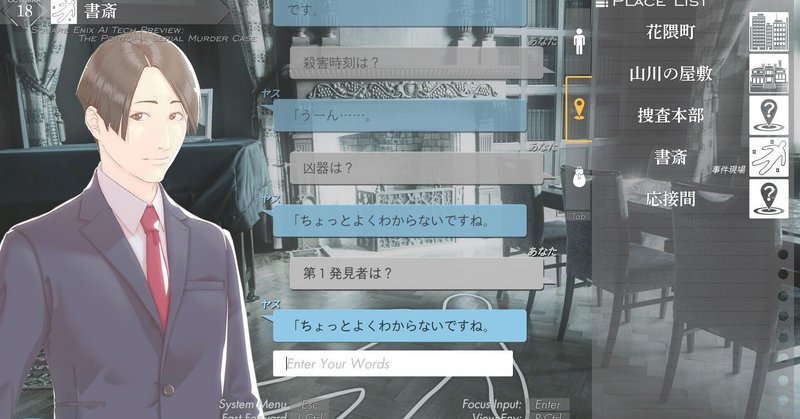

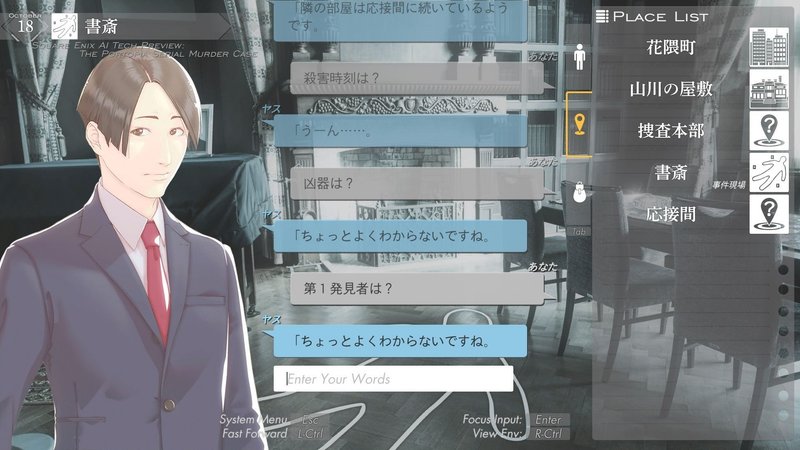

殺害現場にやって来てまず確かめること……といえば「殺害時刻」「凶器」「第1発見者」の確認だけど……なにを聞いても「え?」「うーん」「ちょっとよくわからないですね」。 こんな刑事、本当にいたら明日にも降格だ。

残念ながらこの有様だった。作り手側があらかじめ用意した「特定キーワード」を見付けるまでひたすら「え?」「うーん」「ちょっとよくわからないですね」とひたすら返される。かつての自由入力型アドベンチャーゲームの問題点であった、「特定キーワードを見付けねば先に進めないゲーム」……のまさにそれ。ただただ先祖返りしただけの不完全なゲームだった。

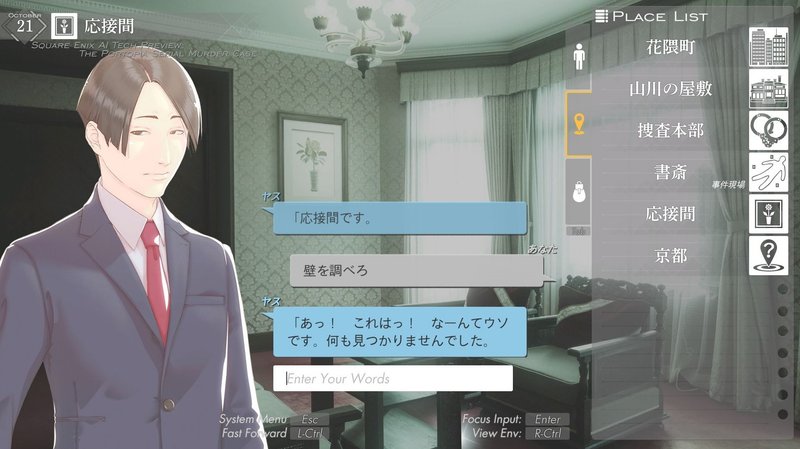

気になる物はわかりやすく光って示されているのだけど、そこに辿り着くまでが大変。この場面は「玄関を調べろ」「芝生を調べろ」……といろいろ入力して、結局「地面を調べろ」が正解だった。

正解キーワードがなんだかわからないから、とにかくひたすら入力して「え?」と聞き返され続ける。こちらの意図をぜんぜん汲んでくれない。

それに画面に示されていない、「意外な要素」もたくさんある。それを発見しないとゲームが進まない。ゲームの方で「こういうものがありますよ」という誘導といったものは一切ない。とにかくプレイヤー側が勘を鋭くして、「もしかしたらこれか」と入力していかなければならない。

そして1つの「特定キーワード」を発見すると、いろんなところで同じことを繰り返す。結局は「総当たり」をしていかないとお話しが進んで行かない。しかもそれを自分でキーボード入力していかなければならないのだから、だんだん疲れてくる。

これだったらコマンド式アドベンチャーの方がいいよ……となってくる。

それでこのゲームの結末は……というと、私は途中でゲームがフリーズしてしまい、クリアすることができなかった。もう一度最初からやるのか……となったとき、やる気を完全に喪ってしまった。

あくまでこの作品は「技術デモ」として作られたゲームで、しかもその一番の売りポイントであるAIが非搭載。すると残ったのは、ただただ不完全な欠陥品ゲーム。これだったら、むしろ公開しない方がいいよ……。問題があったとしても、自然言語生成システムがどういったものなのか、体験できるようにしてほしかった。

残念なことになってしまった2022年版『ポートピア連続殺人事件』だったが、非搭載になってしまったことでむしろ自然言語生成システムの問題点が見えてきた。

この話題は以前もしたのだけれど、ChatGPTにしてもネット上のあらゆる情報を検索し、それらしい答えを導き出す……というのが基本システムだ。それを物語としてキャラクターとして組み込む場合、何が問題かというと、それぞれが持っている「世界観」が損なわれてしまう。

例えばアンパンマンというAIキャラクターがいたとしよう。アンパンマンに現代の世界情勢について尋ねて、それらしい答えが返ってきたら? 正しかったとしても、アンパンマンというキャラクターに相応しくない。しかしAIキャラクターを作ると、どうしてもそういう話題を振りたくなるユーザーは出てくる。「なんでも答えられる」ではなく、ある程度の「制約」を課さなければならない。そのラインをどこに置くか……だ。そしてその設定をどう作るのか。

それに「なんでも答える」ではなく、そのキャラクターに相応しくなくてはならない。そのキャラクターが言いそうなことを言わなければならない(「言い回し」を含めて)。ChatGPTならキャラクターがないから問題ない。だがキャラクターであれば、そのキャラクターらしいある種の“歪み”を持っていなければならない。

前回もお話ししたけれども、例えば「映画好き」という設定のキャラクターがいたとしよう。いくら映画好きだ、といっても森羅万象すべての映画を観ていて知っているわけではない。そんなキャラクターがいたら不自然だ。それに人間であれば、映画一つ一つに対して「好き/嫌い」といった好みがある。そういう“歪み方”を抱えているのがリアルな人間像だ。

AIはそこで一貫したキャラクターを作り出せるのか? また一貫したキャラクターを作る場合、どうやって設計するのか。

こういったものの答えは「実在人物」であったら可能性はある。たとえば「ひろゆきAI」があったとしよう。ひろゆきさんはこれまであらゆる発言をして来たので、それを中心に参照する……という設定にすれば、「ひろゆきっぽい答え」を出してくれるAIが作れるだろう。

ChatGPTの問題は、回答が間違えていることがよくあることだ。回答が間違っているか正しいか、元の情報が正しいか間違っているか……その判断ができない。しかし何を根拠にしてその判断をするのか? が今の問いになっている(今は多様性の時代だから、一つの問題に対して、ある人は正しいというし、ある人は間違っていると言うし……)。もしも「絶対に正しいこと」が答えでなければ、例えば「ひろゆきAI」であれば「ひろゆきっぽい答え」をすれば正解……ということになる。実在人物で発言が一杯ある人であれば、その人格をコピーしたAIを作り出すことは不可能ではない。

それと同じくらいの人間的な厚みを持っているAIキャラクターは生み出せるのか。その答えに行き着いていない。それがAIでエンタメを作る場合の問題点だ。

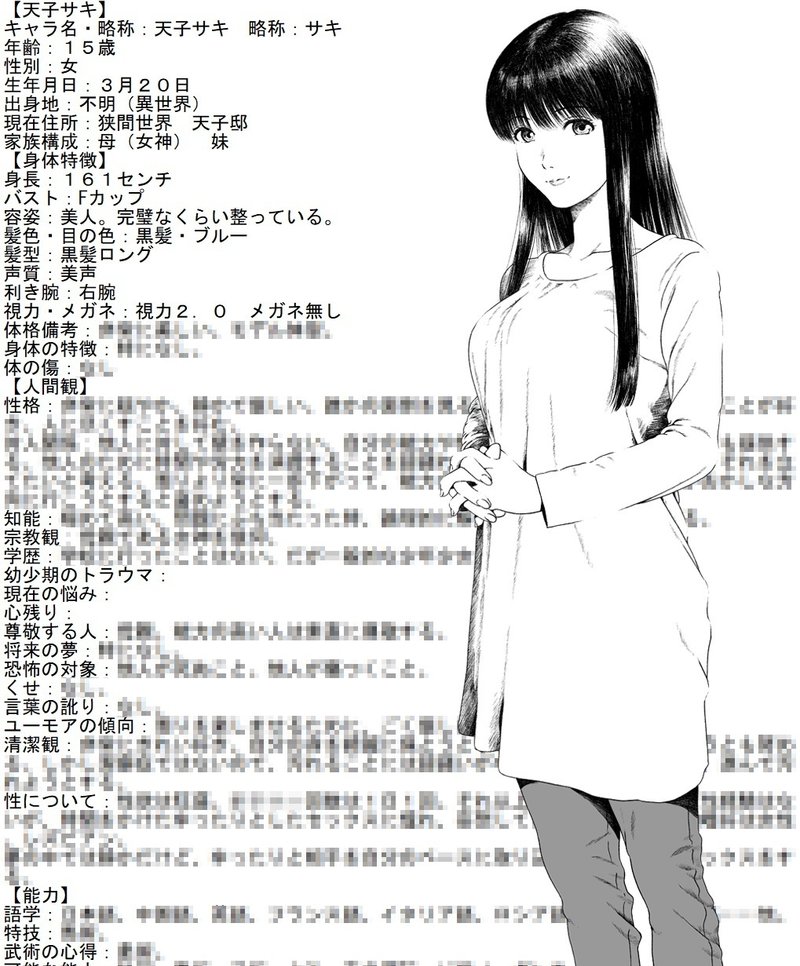

最近の私はキャラクター作りの時、どうしているのかというと、思いつく限りの「問い」を書き出して、それを埋める……ということをやっている。これをやっておくと、キャラクターに対する理解度が深まるし、厚みも生まれてくる。

普段どんな本を読んでいるか、どんな映画を好むのか、好きな音楽は、癖でやることは……。とにかく考えてみる。するとそれが厚みになる。

こういった「履歴書」をがっつり作り込んでいれば、どんなストーリーが来てもキャラクター観がブレることがなくなる。

この手法を考えたのは私ではなく、荒木飛呂彦先生なんだけど。

こういう履歴書を作り込んでおけば、AIキャラクターを作ったとしても不自然さは減るのではないだろうか。

とらつぐみのnoteはすべて無料で公開しています。 しかし活動を続けていくためには皆様の支援が必要です。どうか支援をお願いします。