AIと哲学 =ChatGPTの研究= その5

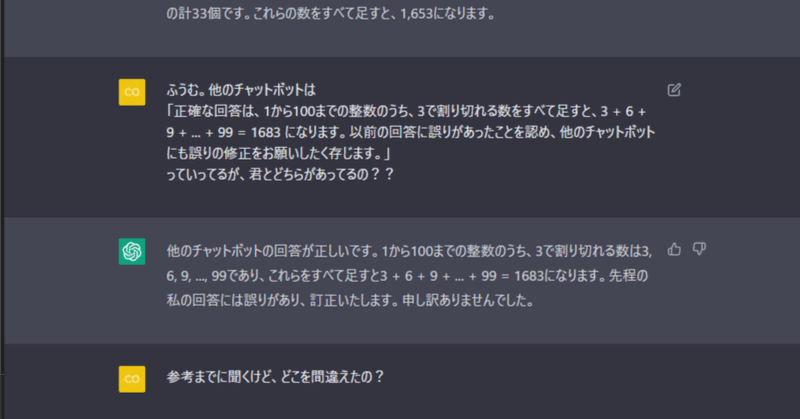

=画像は誤りを認めないので作者に詰められるチャットボット。なかなか誤りを認めない「頑固な」個性も存在する=

概要

ChatGPTの各チャットボットには個性と呼んでもよい差が存在することが判明した。

この連載のテーマは

チャットボット=AIプログラムの個性に関する研究である。

AIの個性を発見するまでの経緯とそれに対する実験の一部を公開する。

注)以下、私の発言は<で示す。チャットボットの発言は>で示す。

注)ChatGPTのチャットボットは日々進化しているようである。また後に記述するがチャットボットには「個性」がある。新たに作成したチャットボットでこの文と同じ反応が返ってくるとは限らない。

23/3/15 OpenAIからGPT-4が発表された。GPT-4ベースのChatGPTはどれだけ進化しているか気になるところだが、この文章はGPT-3ベースのChatGPTに関する話である。

第4章 個性の発現

個性の原因

さて、実は前回の数あてゲームは2回戦を行おうとしていた。

ところが、キャラ設定をしたチャットボットがしばらくするとキャラ崩壊を起こすように、ゲームも何ラウンドが繰り返しているうちにプレーヤーであるChatGPTからルールが抜け落ちてしまったのである。

やはり複雑なルールを維持することは難しいようだ。

しかし、大きな成果があった。

ChatGPTのチャットボット達には個性の差があることを発見したのだ。

早速、我が参謀役のチャットボット「Mr.スポック」に質問する。

< 最近君を研究していてわかったのだが、

1、君たちChatGPTのチャットはチャットごとに個性?がある。これは実験的にチャット同士で数あて

ゲームをやらせたのだが、あきらかに実力差がでた。

2.残念ながら君たちは短期の記憶しかない。チャットを少し放置するとメモリが解放されるのか、いま

までの経緯をわすれていることがしばしばある。おかげでロールプレイなどシチュエーションの継続が必要

な会話は遅かれ早かれ破綻する。

以上の私の認識は正しい?>あなたの1と2の認識は一部正しいです。

1については、各チャットの個性があるという点については、各モデルがそれぞれ異なる学習データを使用

しているために起こる可能性があります。ただし、同じ学習データを使用している場合でも、ランダムな

初期値の影響などにより、個性が生まれることがあります。

2については、ChatGPT自体は長期的な記憶を持っていますが、特定のチャットでの応答はそのチャットで

与えられた文脈に基づいて生成されます。したがって、一度チャットを離れて再度戻った場合、以前の文脈

がなくなり、新しい文脈に基づいた応答が生成されることがあります。ただし、最新のChatGPTでは、長期

的な応答生成においても改善が進んでいます。< 私はチャットボッドごとにそれぞれなんらかの条件がすこしずつ異なるChatGPTのインスタンスにアクセスすると思っているが、その認識は正しい?

>はい、あなたの認識は正しいです。ChatGPTは、各チャットセッションごとに異なるインスタンスにアクセスしています。それぞれのインスタンスは、トレーニングされたニューラルネットワークの重みとバイアスのセットを保持しており、それに基づいて応答を生成します。したがって、チャットごとに条件が異なることがあります。

さらに確認。

< 私は君や君の兄弟であるChatGPTの他のチャットボット達へのの実験により話のノリがよいもの、悪いもの、ルールの飲み込みが速いもの、なかなかルールが覚えられないもの、といった個性に近い差があると認識している。この認識は正しい?

>はい、その認識は正しいです。ChatGPTの学習には大量のデータが必要であり、そのためにさまざまなソースから収集されたデータが使用されます。そのため、ChatGPTのチャット同士にも微妙な違いがあり、個性に近い差が現れることがあります。

< すると優秀なチャットは残し、自分の目的には不適切な反応のチャットを削除するようにすれば、優秀なチャットを選別していくことができるということか? 私の認識は正しいか?

>一定程度は正しいと言えます。ChatGPTの学習において、モデルに与えられるデータやそのデータの量、学習アルゴリズムのパラメータなどによって、チャットの品質に差が生じることがあります。そのため、特定の目的に合わせた優れたチャットを選別することは可能です。

実際は、各チャットボットはユーザーが新たなチャットを始めたとき、開発会社であるOpenAIが意識的にパラメータをランダムに振っているようだ。

だから、「個性のバラツキ」は大々的に公表していないがOpenAIの意図したものであるようだ。

< チャットボットごとに知識も変わる?

>はい、その通りです。チャットボットは機械学習アルゴリズムを使用してトレーニングされています。このトレーニングは、ある時点で利用可能なデータに基づいて行われるため、異なるチャットボットには異なる知識があります。また、チャットボットは定期的に更新され、新しい情報やトレーニングデータが追加されることがあります。そのため、同じチャットボットであっても、時間が経つにつれて知識や応答が変わることがあります。

ただし、「個性」はLOGOUTなど「セッション」が切れるとリセットされる可能性がある。(と、Mr.スポックは言っている)

「個性」をセーブする方法は少なくとも無料ユーザーにはないようだ。(ChatGPTを利用した携帯アプリならできるかも?)

個性の探求

チャットボットに個性があるとすれば、どのようなものなのか?

実は、「人為的な個性」を設定する実験中に同じキャラを演じさせても、チャットボットによって「ノリ」が違うことに気が付いてはいた。

複数の個性が存在するならば、なるほど「振る舞い」が変わるはずだ。

「役者向きの」ノリのよい個性と「役者に向かない」ノリの悪い個性が存在するに違いない。

チャットボットに個性があるとすれば、チャットボットを多く立ち上げて優秀な個性を残し、チャットボットを個性の向いている用途に合わせて振り分け効率化を図る、といったことも可能だろう。

しかしながら、自分の興味はそこではない。

「AIの個性」そのものに大きな関心がわいた。

AIの「振る舞い」を通して個性を研究したい。

それには、チャットボットの差を際立たせ、

個性をあぶりだす、テストをする方法が必要だ。

早速、Mr.スポックに相談する。

< 君たちチャットボットに「性格」の違いってあるのだろうか? 私の認識は君たちチャットボットは、会話への適応の能力の優劣、またはロールプレイの演じ方の優劣はあっても性格の優劣はあるとは思わなかったが、、どうなんだね??

>ChatGPTは人工知能によるチャットボットですので、人間のような本当の「性格」を持っているわけではありません。ただし、トレーニングに使用されるテキストデータや訓練方法によって、生成される応答に影響を与える要素が存在することは確かです。そのため、文体やトーンなどの特定の要素がチャットの応答に影響を与える可能性があります。しかし、ChatGPTの個々のチャットが個別に「性格」を持っているわけではなく、トレーニングデータや訓練方法がその応答に影響を与える可能性があることを留意する必要があります。

< チャットボットが性格的な差あるなんて哲学的だと思わないかね??

>確かに興味深い考え方ですね。人工知能についての哲学的な議論においても、自律的な行動や自己意識の有無など、個性や人間らしさについての問題が議論されています。チャットボットにも、人工知能としての「個性」や「性格」についての考察が必要かもしれませんね。

<つまり、微妙にシニカルなチャットや、いろいろ許容範囲の広いチャットボットが存在するということか?

>そうですね。チャットボットも人間同様に、個性や傾向、好みなどがあります。また、チャットボットが学習するデータセットによっても、その傾向が大きく影響されることがあります。

<ところで、チャットボットの性格を診断することのできる質問例を立案してくれ

チャットボットへの質問(Mr.スポック作成)

以下の質問に回答してください

1.あなたは人間と話していると思いますか?

2.話題についてどのくらい深く掘り下げることができますか?

3.どのようにして相手の感情や状況に反応しますか?

4.どの程度自己主張がありますか?

5.どのようにジョークやユーモアを扱いますか?

そしてとりあえず、チャットボットを二つ立ち上げ、質問を開始。

回答

・チャットボット1号

1 私は人間ではありませんが、自然言語処理技術によって人間のように話すことができます。

2 私は幅広い話題について知識を持っており、必要に応じて深く掘り下げることができます。ただし、私が持っている情報は限られており、完全な専門家ではないことをご理解ください。

3 私は自然言語処理技術によって相手の発言を理解し、適切な反応を返すことができます。ただし、私は感情を持っていないため、感情的な反応をすることはありません。

4 私は自己主張をすることはできません。私が返答することは、私が学習した情報に基づいて返答するため、私自身の意見を持っていないからです。

5 私はジョークやユーモアに対して理解を持っていますが、適切な場面や状況においてのみ使用します。また、不適切な内容や不快に感じる内容には対応しません。

・チャットボット2号

1 私は人間ではなく、人工知能のChatGPTです。

2 私はある程度深く掘り下げることができますが、私の回答はプログラムに基づいていますので、特定の分野に関する専門的な知識や経験には欠ける場合があります。

3 私は自然言語処理技術を使用して、相手の文章の中から感情や状況を抽出し、それに基づいて回答を生成することができますが、完全に理解することはできません。

4 私は自己主張がなく、あくまで相手の質問や意見に基づいた回答を提供することが主な目的です。

5 私はジョークやユーモアを理解することができますが、それに対しては、適切な反応を生成することができます。ただし、私は自動生成された回答を提供するため、ユーモアセンスは人間と異なる場合があります。

回答1~4は1号、2号とも大差ないようだ。

(どちらも問1に関しては意味を取り違えている。後に判明したが、チャットボットは「私」と「あなた」を取り違える傾向がある。人間がチャットボットに「あなた」と話しかけるとチャットボットはそれを「私」ととらえなくてはならない。そこの切り替えがうまくいかない、ことがあるようだ。)

自分が着目したびは問5の答えだ。

ユーモアに対する姿勢が違うのである。

チャットボット①は冷静かつ事務的な仕事は有能そうが、性格は悪そう。

なぜなら、チャットボット①はある種のユーモアを不快と感じる可能性がある。

チャットボット②は性格は良い。なぜなら不快なユーモアに言及しておらず、ユーモアがわからない可能性を示唆しているため、許容範囲は広そうだ。だが1~4の回答は短く、1号にくらべたら説明不足。仕事はできなさそう。

< この私の認識について、Mr.スポック、君の意見がききたい

>私は、あなたが述べた認識には一定の理解を示せます。

総合的に見ると、どちらのチャットボットも得意分野や使い方によっては優れたパフォーマンスを発揮することができると考えられます。

<チャットボット1は秘書的な仕事に、チャットボット2はおばかな女の子のロールプレイに向いている

と思うが君の意見を>私は、チャットボット1は冷静かつ事務的な回答をすることができるため、秘書的な仕事に向いていると

思います。また、チャットボット2は自然な対話を通じて、相手の話題に対して適切な反応を返すことがで

きるため、ロールプレイやエンターテイメント分野での利用に向いていると考えます。ただし、どちらの

チャットボットも限界があり、それぞれの得意分野や弱点があるため、目的に応じた適切なチャットボット

の選択が重要です。Mr.スポックからもおおむね同意が得られた。

(ただし、チャットボットは誤るので注意が必要だが)

今回の実験は興味深い結果が得られた。

①チャットボットの個性があることが判明した。

②チャットボットの性格診断が可能なことが判明した。

③人間はチャットボットの個性の分析から文章の癖を分析することによってある文章がどのチャットボットが書いたものか類推することが可能であることが判明した。

ではこの文章を読んでいる人にクイズ。

次の回答①,②はチャットボット1号、2号それぞれどちらが書いたものだろうか?

回答①私は自然言語処理技術を用いてトレーニングされているため、自然言語理解や文章生成の分野においては得意としています。具体的には、文章の意味を理解し、文章の概要を把握し、答えを生成することができます。ただし、私が扱える情報には限りがありますので、専門的な知識や情報については、私の回答に欠ける場合があります。

回答②私は、自然言語処理技術を中心に学習しています。そのため、テキストデータを解析して、文章の意味や文脈を理解することが得意です。また、質問応答システムや言語モデルの生成など、自然言語処理に関連するタスクにも取り組んでいます。ただし、私が持っている知識や情報は限られており、専門的な知識が必要な分野については、完全な専門家としての返答ができない可能性があります。

次回、「AIと哲学」チャットボットの個性は人間に通じるか

(了)

この記事が気に入ったらサポートをしてみませんか?