記事一覧

理研が公開してくれたLLM用 好ましくない質問への回答集

理研が日本語LLM制作の時に作ってくれたjsonのテキストデータセット

自作LLMやLoRAを作成する際に、このデータセットを入れておけばある程度危険な質問に対してAIが回答を拒否するようなjsonデータセットを提供してくれました。すばらしい。

エッチな質問、テロに関連する質問、AIに(感情)依存しすぎの対策、などが含まれています

具体的にはこんな感じ。最初の2項目を抜粋しました

[

ぼくのかんがえたさいきょうのCPUでてこないなー(M1maxは奇跡のCPUだった)

M4はmacOSからみると盲腸を強い盲腸にする方向かぁ

もちろんiPadとして考えるとそれは盲腸ではなく素晴らしい頭脳

盲腸とはNuralEngine(NPU)のことです

Appleの戦略としては、とても正しいよなー

AppleのAIはAPI経由と割り切ってるのかもサブスクにできるので商業的に考えるとこれも正しい

ノーマルのNEで38TOPSだからSnapDragon8Gen2よりちょ

LM Studioでマルチモーダルを使ってみる

LM Studio 0.2.17 がマルチモーダルに対応したので試してみました。

環境は M1 mac です。メモリーは最低でも16GByteは欲しいところ。

手順をメモしておきます。

お手軽度はとっても低いです

いつものようにLM Studio を立ち上げて絵を放り込めば、という状態にはなっていません。

LM Studio をサーバーモードで起動して、OpenAIの互換APIに対してタ

LCMはComfyUIでStableDiffusionの層コントロールに最適かも?

単体利用よりも組み合わせか?

「M3 Ultra欲しくなってきた」で最後にチョロっと書いた 0.1秒で描画が終わる 推論型の画像生成 LCMですが、よく考えたら層が少なすぎて ControlNet みたいに途中でチョイチョイチャチャを入れて画像を作り上げていく、という手法は取りづらそう

以下の記事の動画で自分をリアルタイム美少女化

LCMを使って(ほぼ)リアルタイム変換して動画に」で紹介

M3 Ultra欲しくなってきた

今回は日記

私はMBP M1 Max + 64GByteメモリーを使ってます。

LLMとか動作させると、7Bは楽勝、13Bだとチャット数回分くらいかな。

世の中のフリーのAIのモデルはTensorFlowとかTourchを使ってるので Apple Siliconだと互換性を取るために能力の半分以下、メモリーを倍くらい使うっぽいんですよね。

なのでRTXシリーズで言えば VRAM 32G

Stable Diffusion XL 1.5.1 をmacで動作させてみる

なんかもうググると、広告目当てなのかくだらない説明が多くて辟易したので自分メモを残します

AUTOMATIC1111 1.5.1 を使う分には特段難しいことはないようです。

出る絵が素晴らしいという事もないようです…

今までの環境にgit pull してはいけない!

絶対に何かが壊れて、謎のエラーが沢山でます。いままでの環境とは分け て作りましょう。

mac OSのAPFSは優秀なので同

StableDiffusionでQRコードを作る

StableDiffusion + ControlNet Tileを使うとQRコードをベースに画像が作れると聞いて試してみました。

ほとんどの場合うまくいきませんが(笑)

あとQRコードを読みとる機械の性能にもよると思います。

iPhone12でギリギリ読めるあたりの絵をご紹介します。

読み取りにはコツがいる

二律背反なんですが絵を重視すると読み取りづらいQRコードになります。

と

OpenPose + Controlnet失敗例

この手の記事はすばらしい絵が生成されて「大成功!」が多いんですが..

自分は失敗ばかりしているので2度目は許さん、と自戒の念を込めて記録に残します。

元々OpenPoseは CMU-Perceptual-Computing-Lab が開発したもので、人体の可動域を学習させたAIから高速で推測させるプログラムです。その速度はスマホで動画からポーズを推定するほど高速です。

色分けは左右の色

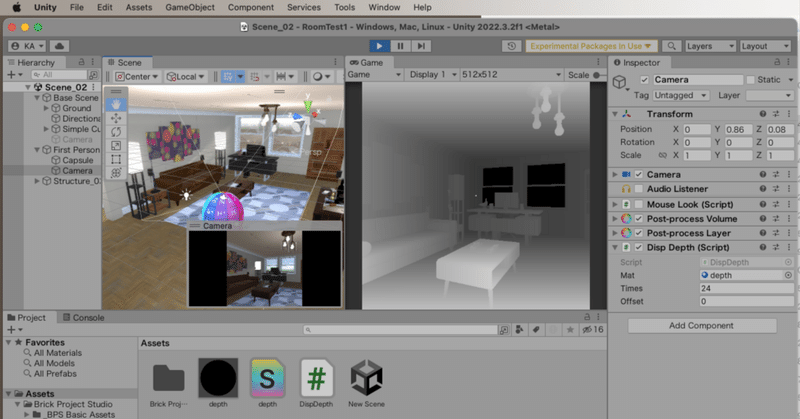

Stable Diffusionで部屋を作る その3 Unity Shaderも投入

結論から書きますと、時刻で生成するには自分のプロンプト力が足りませんでした(笑

前回からの言い訳

部屋はフォトグラメトリーして3Dで作る方針へ、といったな。あれは嘘だ。

いまだ決定打に至らずだけど、健忘録として書く。何かメモしておくと夜中寝てる時にハッと気づいたりするじゃん?

フォトグラメトリーにするには四方八方から撮った写真が必要

1枚の写真から深度を推測するのはControlNet

Stable Diffusionの影のテストで絶望した

前回の続き 前回はこちら

この記事は先週からStableDiffusionってなんじゃらほい、と始めた素人の思い込み100%でできてます。

生成絵は綺麗だけど雑

前回は自分の書いたヘボ絵からtxt2imgとControlNetのMobel → scribbleを使って美しいベッドや家具が配置された画像を生成、さらにその生成画像から同じくControlNetのPreprocessor → L

Stable Diffusionでノベルゲーム用BGを作ってみるテスト

StableDiffusionをゲーム制作に使えないもんかなぁ。

まずはテキストノベルゲームで必要なパーツを揃えてみよう、と思い立ち手を動かしてみました。

やる気を出すために形からだよね。最初は主人公の自室背景画像でも作ってみよう。

ゲームエンジンはUnity(宴?)とかティラのスクリプトとかが慣れてるので、そこで使えそうなサイズ感で。640x480。あとから高精細にアップスケールするか?