「人工意識」という野望2

前回の続きです。

日本の研究者でも「人工意識」にチャレンジしている方はいます。

その一人として金井良太氏を取り上げます。

この方は、国のムーンショットプログラム(その名の通り野心的な挑戦を支える計画)で、身体・知覚能力を拡張して自由自在にするために、BMI(Brain Machine Interface)分野を担当しています。下記がサイトです。

金井氏は、さらに大胆に「AIに意識を持たせよう」としています。参考書籍をもとに、そのアプローチを紹介してみます。この本は意識の科学の歴史的経緯を自身の考えの変遷に照らして書いているのでとても分かりやすいです。ぜひ興味ある方はポチってみてください☺

改めて、「意識の科学」が難しいのはそれが主観的体験であることです。

ですので、この難題をどのように裁くのかがカギです。

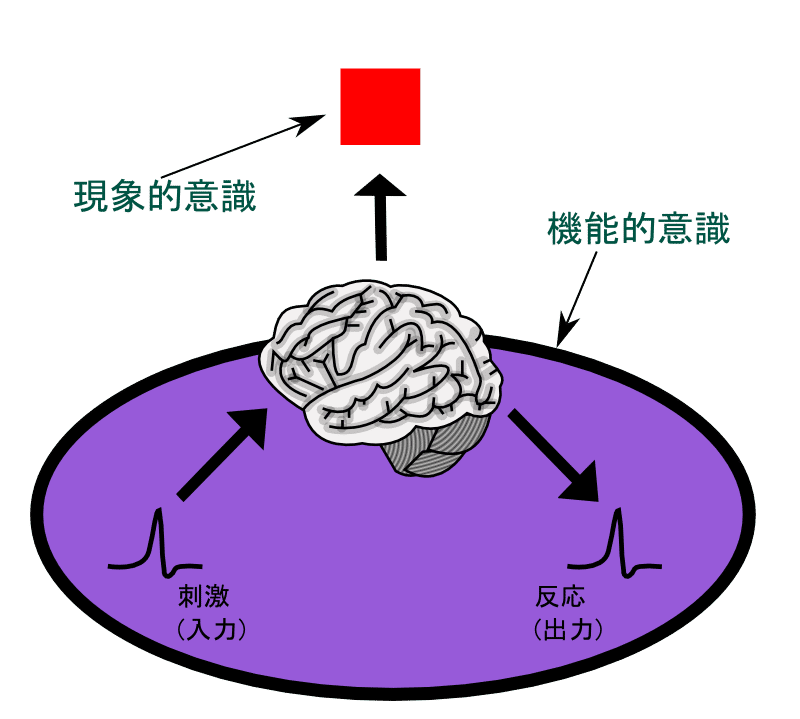

歴史的に良く知られているのは、前回ふれたチャーマーズが唱えた「ハードプロブレム」と言われているものです。Wikiの画像が分かりやすいので引用します。

上図の

「機能的意識(客観)が現象的意識(主観)にどうつながるのか?」

がハードプロブレムです。(一方、イージー版は機能的意識の解明)

それに対して、前回も取り上げたIITはその問題自体を不要にします。

ポイントは

「現象的意識があるところから理論を構築している」

という点です。数学でいう「公理」を「意識現象ありき」にもってきたということですね。

ここで「むむっ」となるかもしれませんが、物理現象に例えると、「光速不変」みたいなものです。これもこの原理からスタートして理論を構築し、客観的な自然現象を検証する限り「確からしい」となっています。

このアプローチの良い点は、数理モデルなので定量的評価ができる点です。

ただ、あまりにもIITは複雑なモデルで今もバージョンアップ(投稿時点ではver3)しているので、現時点ですぐに実証するのは難しそうです。

金井氏はそれに対して、IITを評価基盤として「人工意識」を創ろうとしています。

具体的には、意識に関係があると思われる脳機能を単純化したAIをつくってIIT(かその補正版)が定義する情報量(φ)を評価します。

実験を重ねてφが高い状態をつくる(意識がありそうな)ことが出来たら、その状態で人間の脳とつないで、主観的意識が現れるかを検証します。

なお、GPTをはじめとした現在のLLMは、IITの下記定義上、意識を持っていないことになるそうです。

・因果計算を行っている(相関ではない)

・再帰処理を行っている

そのギャップに対しては、IIT自体を拡張することでAIにも意識を持たせようとしているようです。

拡張方針としては、前回ふれた既存の意識理論を組み合わせることです。

例えばIITのライバルとして見られがちな「グローバルワークスペース理論(GWS)」もその1つです。

ざっくりいえば、様々なモジュール群があり、そのモジュール間の繋がり度合いが高まると意識として経験されるというものです。

例えば、今の生成AIブームは主に「言語」ですが、マルチモーダルと称して今後の応用が期待されています。身体性を持つロボットもその1つです。

言語・画像・音声、そして人間でいう想像力にあたる「世界モデル」、それぞれをモジュールとし、目的に応じて併用します。

それをIITに従った情報量(シャノンの情報理論とは別)で評価することでAIが意識をもつかどうかを判別する、というイメージです。

公式サイトでも解説があるので載せておきます。

今のAI進化も汲んでいるので、とてもリアリティを感じます。(評価手法のIITはまだ深く理解できていないのであれですが・・・)

いずれにしても、長年アンタッチャブルで日の目を浴びなかった「意識の科学」が、今ブームのAIへの研究を逆に推進する可能性もありそうでワクワクします☺

<参考>

この記事が気に入ったらサポートをしてみませんか?