記事一覧

Make a sign saying Hello Kitty diary book 2024とGPT4oに注文すると

Here is the sign with the text "Hello Kitty Diary Book 2024." If you need any adjustments or further assistance, feel free to let me know!

と出力してくれました。今までできなかった英語テキストを正しく綴れるようになりました。文字のデザインがクールです。

Hel

Microsoft Copilot+ PCは、Apple Macbook iPhoneに勝てるか?ArmとNPUによるエッジコンピューティングでAI処理が特徴しかし、話者は区別できない

マイクロソフトのCopilot+ PCは、AI機能を備えた新しいカテゴリーのWindows PCです。

ArmアーキテクチャのチップとNPUによるエッジコンピューティングが大きな特徴で、クラウドに依存せずに高度なAI処理が可能です。ユーザーは高速かつ効率的にAIタスクを実行できる環境を提供します。

ライブ翻訳機能を搭載し ビデオ通話と連動し対面会話にも使用可能であるが話者の区別はできない。

A

メディアテック、Nvidiaと共同でAI PC開発アーキテクチャプロセッサを攻略へ

メディアテック、Nvidiaと共同でAI PC開発

アーキテクチャプロセッサを攻略へ

経済日報 2024/05/13 03:40:35

Armプロセッサの共同開発が第3の足となる。

AIパソコン市場の成長が有望視される中、メディアテック(2454)は同市場への参入に力を入れている。 同社はエヌビディアと手を組み、Armアーキテクチャを採用したAIパソコン用プロセッサを開発するとの噂があり、第3

メディアテックとNvidiaが提携してチップを開発する、AI PC向けAIスーパーチップを共同開発、QualcommのSnapdragon対抗

メディアテックとNvidiaが提携してチップを開発する、

AI PC向けAIスーパーチップを共同開発、

QualcommのSnapdragon対抗。

アーキテクチャ:ARMアーキテクチャを採用。省電力で高性能デバイスや組み込みシステム

製造プロセス:3ナノメートルプロセスで製造されます。

用途:AI PCは、高度なAI処理能力を持ち、ローカルでのAIタスク処理が可能。クラウドへの依存を減らし

GPT4oの正式版がまだ正式にリリースされないので現行のGPT4oの実力を試した。これがあればgoogle検索不要ですね。

これがあればgoogle検索不要ですね。

これ一発でgoogle検索ノックアウトす。

これが私の言う「ドラえもん」です。

このドラえもんは はじめ、「かねりん」のいみがわからなくて

「どういう意味でしょうか?

それとも特定の詐欺についてお話していますか?」

というききかえしてきました。

「賢い」

かねりんのうなぎの写真をうまく探せなくて違うものを出してきた

自分でも、間違っていると認識して、突然

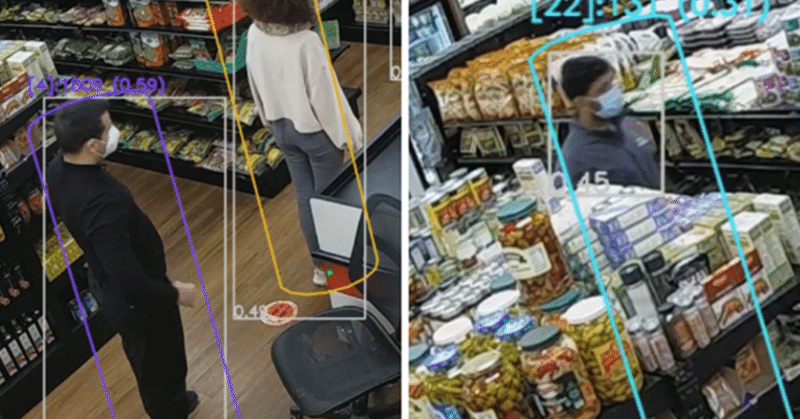

[論文解説]NVIDIA DeepStreamのシングルビュー3Dトラッキングを使用した視覚知覚におけるオクルージョンの軽減

Nvidia技術ブログから

概要

交通監視、倉庫の安全性、小売店の店員分析などのインテリジェント・ビデオ・アナリティクス(IVA)アプリケーションの知覚に関して言えば、最大の課題の1つはオクルージョンである。

例えば、人は構造的な障害物の陰に隠れたり、小売店の店員は棚に隠れて完全に見えなかったり、車は大型トラックの陰に隠れたりします。

この記事では、NVIDIA DeepStream SDKの新

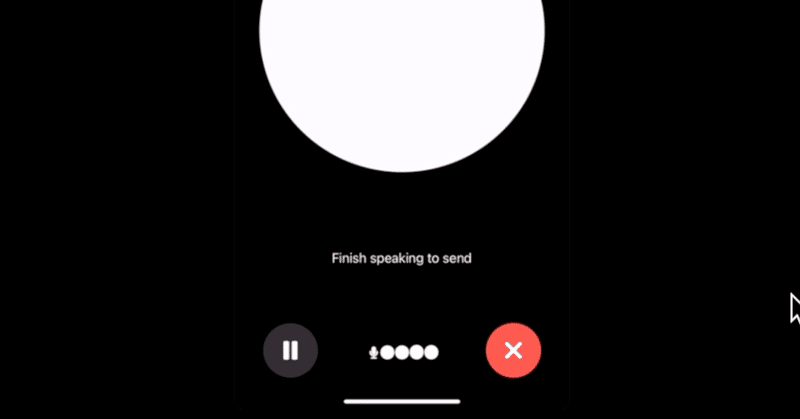

Mac用デスクトップアプリをダウンロードして試した。Microsoftがco-pilotボタン付きパソコンを販売する前にアップルのMacbookにドラエモンボタンをつけてMicrosoftに対抗するしたかに見える。

ChatGPT MacOSアプリダウンロードしました

PlusユーザーにmacOSアプリを配布しています。

クール:ボタン一発で

ボイスモードをはじめ、GPT-4oの新しいオーディオおよびビデオ機能により、コンピュータから直接ChatGPTでボイス会話ができるようになりました。

社内で新しいアイデアを出したいとき、

面接の準備をしたいとき、

話したいトピックがあるときなど、

デスクトップアプリ

ChatGPT4omuniでGoogleのAI発表会を説明してもらう音声応答で説明させた。曖昧な会話でも突然英語で質問してもOK

ChatGPT4omuniでGoogleのAI発表会を説明してもらう

音声応答で説明させた。曖昧な会話でも突然英語で質問してもOK

Me:Googleの最新のAI発表会でカメラを使ったデモを説明して

Googleの最新のAI発表会では、Gemini 1.5という次世代のAIモデルが発表されました。このモデルはマルチモーダルAIで、テキスト、画像、音声、動画などのさまざまな形式の情報を統合的に理解

ChatGPT 4oを試した。マイクを通じ私が英語でしゃべり、ChatGPT 4が音声で応答してくれた。ビデオをみせて何が録画されているか聞いた。

ビデオは台湾の故宮博物館です。

何が見えているか理解しているが一発で故宮博物館と認識するのは難しかった。

以下会話

Me: can you see me?

ChatGPT

I can't see you. I can only interact with you through text. If you have any questions or need assistance, feel fr

OpenAI GPT4-o動画のシーンを説明できる. AIの目が人間並に進歩

GPT4-o でできること

1. 人間に近い感情表現: リアルタイムの会話音声と感情の理解ができる。

2.人間に近い目と脳: リアルタイムで見えている物理世界を表現できる

GPT4-o でできないこと

1.時間認識;5分前の物理状況を表現できない

OpenAI GPT4-o 発表物理状況を見て判断できるのでドラえもんにちかくなった/声で感情も表現できる

私はアップルがSiriにOpenAIを採用し

物理状況を見て判断でき、美しい声で感情を表現できる

ドラえもん機能を盛り込んでくれるよう期待する。

GPT4-o の特徴

GPT-4oの紹介: ミラ・ムラティがGPT-4oという新しいフラッグシップモデルのChatGPTの発表を行い、無料ユーザーを含むすべてのユーザーに広く利用可能になることを発表しました。このモデルはテキスト、ビジョン、音声の能力

Nvidiaは企業が独自データを学習させる方法を開放/ラージ生成AIにもJetsonロボにも適用可能

Nvidiaは企業が独自データを学習させる方法を開放

ラージ生成AIにもJetsonロボにも適用可能

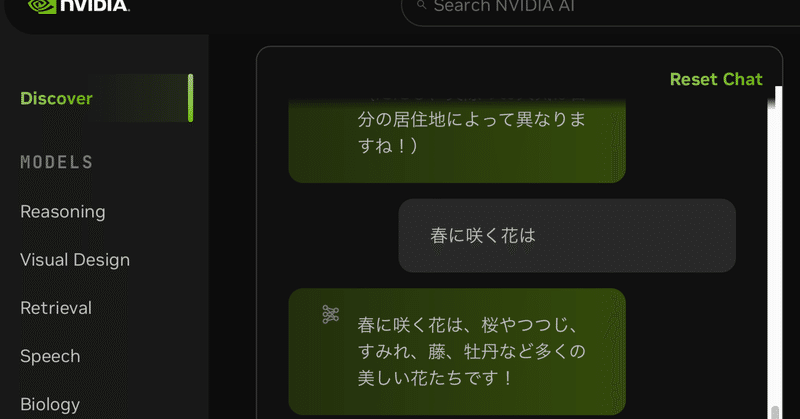

上記をPRするためNvidiaは自社サイトに独自データ学習、

Jetsonロボ適用可能を体験できるウエブサイトを設けました。

開発者はブラウザを使用して、[NVIDIA の公式ウェブサイト]

(https://ai.nvidia.com/)で Llama 3 を試すことができます。

「春に咲